Démystifier la précision de la parole au texte

Un guide complet sur la précision de la parole au texte. Apprenez comment elle est mesurée, les facteurs qui l'influencent et des stratégies concrètes pour obtenir des transcriptions plus claires.

Kate

October 4, 2023

Nous avons tous vu une légende automatisée comiquement mauvaise qui manque complètement la cible. Mais lorsque les enjeux sont élevés, la précision de la parole au texte est non négociable. C'est la mesure décisive de la façon dont une machine transforme les mots parlés en texte écrit, et même de minuscules erreurs peuvent créer des problèmes massifs.

Pourquoi les industries à enjeux élevés exigent la précision

Pensez à un sténographe judiciaire qui enregistre chaque mot d'un témoignage juridique. Une seule phrase mal interprétée — comme transcrire "il a des antécédents connus de violence" par "il n'a pas d'antécédents de violence" — pourrait complètement changer l'issue d'une affaire. C'est un exemple parfait de la raison pour laquelle la précision est plus qu'un simple score technique ; c'est le fondement de la confiance pour les applications critiques.

Il en va de même pour les soins de santé, où une erreur de transcription dans les notes d'un médecin pourrait entraîner un mauvais diagnostic ou une mauvaise médication. Et pour les entreprises qui essaient de comprendre les appels du service client, des transcriptions désordonnées signifient des données erronées. Vous finissez par prendre des décisions stratégiques basées sur une image déformée de ce que vos clients disent réellement.

L'évolution de la précision

Atteindre les normes actuelles a été un long chemin. En 2001, la reconnaissance vocale atteignait environ 80 % de précision, ce qui était une énorme avancée à l'époque. Cela reposait sur des modèles statistiques des années 1980 qui ont fait passer les vocabulaires de quelques centaines de mots à des milliers.

Puis, vers 2007, les choses ont vraiment commencé à s'accélérer lorsque la recherche vocale de Google a jeté son énorme ensemble de données — un stupéfiant 230 milliards de mots provenant des recherches des utilisateurs — sur le problème, améliorant considérablement sa puissance prédictive. Vous pouvez en fait explorer l'historique de ces améliorations et voir à quel point la technologie a progressé.

Des transcriptions inexactes créent un effet d'entraînement. Elles ne causent pas seulement de la confusion ; elles sapent la confiance dans la technologie, érodent la valeur des informations basées sur les données et peuvent introduire des risques de conformité sérieux.

Le point essentiel est simple : une mauvaise précision rend les données vocales inutiles, ou pire, dangereusement trompeuses. Obtenir la plus haute précision de parole à texte possible est absolument essentiel pour toute organisation qui s'appuie sur la voix pour :

-

Conformité et documentation juridique : Capturer chaque mot avec précision pour les dossiers juridiques, les dépositions et les dépôts réglementaires.

-

Intelligence d'affaires : Tirer des informations claires et exploitables des commentaires des clients, des appels de vente et des réunions internes sans données corrompues.

-

Expérience utilisateur : Fournir des légendes fiables, du contenu accessible et des commandes vocales qui fonctionnent réellement, renforçant la confiance des utilisateurs au lieu de la frustration.

Comment nous mesurons la précision de la transcription

Avant de pouvoir améliorer la précision de la parole au texte, vous devez d'abord la mesurer. Comment évaluez-vous réellement la façon dont une machine "écoute" ?

La norme industrielle pour cela est une métrique appelée Taux d'erreur de mots (WER). Pensez-y comme à un score de golf pour vos transcriptions : plus le chiffre est bas, meilleures sont les performances. Cela nous donne un moyen simple et concret de juger à quel point la transcription d'une IA correspond à une version parfaite, vérifiée par un humain.

Une transcription parfaite obtient un WER de 0 %. Au lieu d'une formule complexe, il s'agit simplement d'un décompte des erreurs commises par l'IA, divisé par le nombre total de mots dans la transcription correcte.

Les trois types d'erreurs de transcription

Lorsque nous calculons le WER, nous recherchons trois types d'erreurs spécifiques. Chacun ajoute au compte d'erreurs et augmente ce score.

-

Substitutions (S) : C'est lorsque l'IA entend un mot mais en écrit un autre. Par exemple, le locuteur dit : "Rendez-vous mardi", mais la transcription indique : "Rendez-vous jeudi".

-

Suppressions (D) : C'est simple : l'IA manque complètement un mot. L'audio pourrait dire : "Veuillez envoyer le rapport final", mais la transcription ne capture que : "Veuillez envoyer le rapport".

-

Insertions (I) : L'inverse d'une suppression. Ici, l'IA ajoute un mot qui n'a jamais été prononcé. Par exemple, "Vérifiez le statut" est transcrit comme "Vérifiez sur le statut".

Pour obtenir le score final, il suffit d'additionner toutes les substitutions, suppressions et insertions, puis de diviser ce total par le nombre de mots dans la transcription originale correcte.

La formule ressemble à ceci : WER = (S + D + I) / N

Où S = Substitutions, D = Suppressions, I = Insertions, et N = Nombre total de mots dans la transcription correcte.

Passons en revue un exemple rapide pour voir cela en action.

Exemple de calcul du taux d'erreur de mots (WER)

Ce tableau détaille comment les erreurs sont comptées lors de la comparaison des mots parlés originaux avec ce que l'IA a transcrit.

Type d'erreur | Phrase originale | Texte transcrit | Nombre d'erreurs |

|---|---|---|---|

Suppression | "Envoyez-moi la facture" | "Envoyez-moi facture" | 1 |

Insertion | "Vérifiez le statut" | "Vérifiez sur le statut" | 1 |

Substitution | "Rendez-vous mardi" | "Rendez-vous jeudi" | 1 |

Total des erreurs | 3 |

Dans ce cas simple, avec un total de 10 mots originaux et 3 erreurs identifiées, le WER serait de 30 %. Ce seul pourcentage nous donne une référence claire des performances.

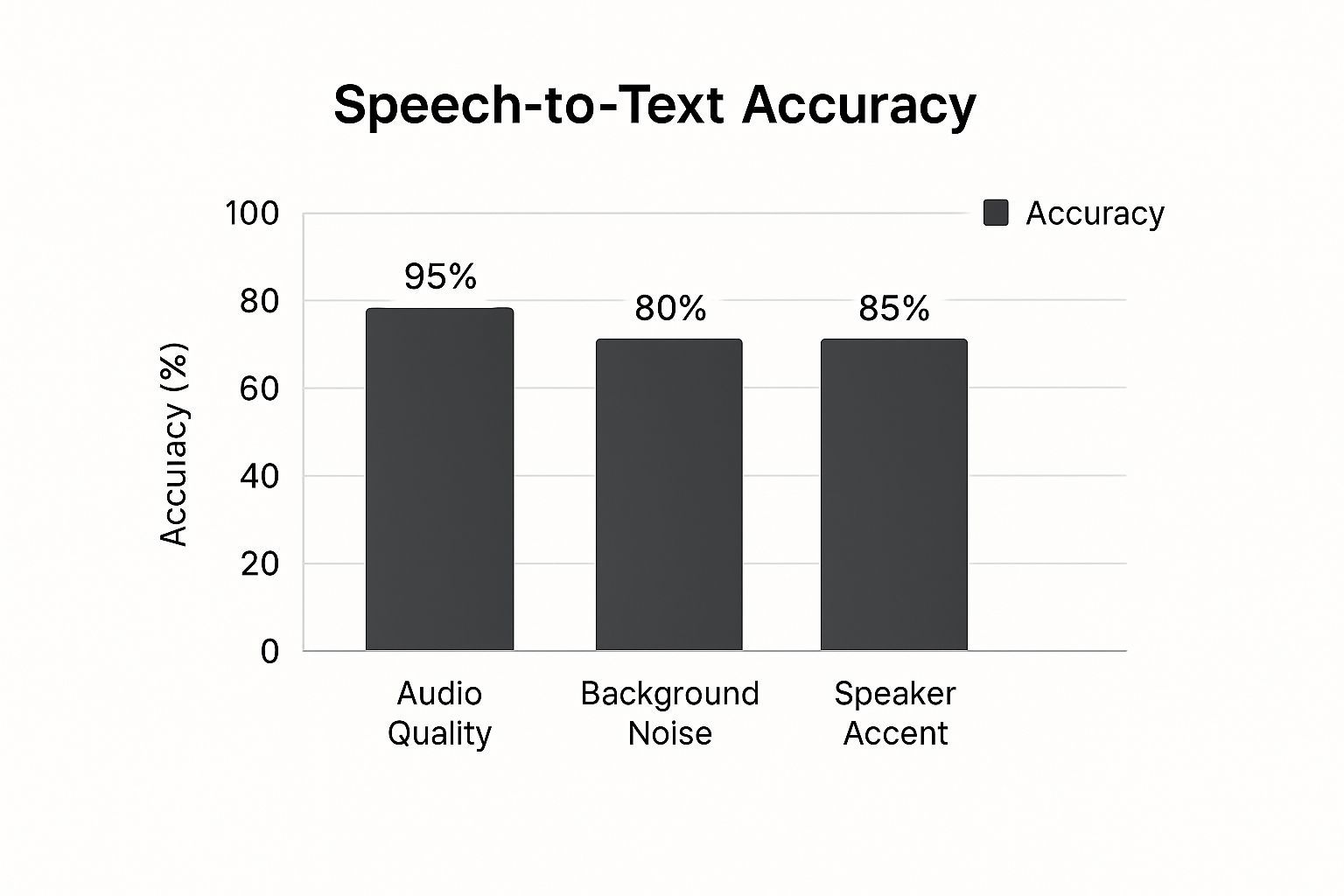

L'image ci-dessous montre à quel point les différents facteurs du monde réel peuvent entraîner l'accumulation de ces erreurs, faisant grimper le WER.

Comme vous pouvez le constater, rien n'est plus important qu'un audio propre et de haute qualité. Des éléments tels que le bruit de fond important, plusieurs personnes parlant en même temps ou des accents forts peuvent rapidement dégrader la précision. Comprendre ce qui cause ces erreurs est la première étape pour les prévenir.

Les facteurs du monde réel qui ont un impact sur la précision

Si vous avez déjà crié "Hé, Siri !" pour obtenir une réponse déroutante, vous savez déjà que la précision de la parole au texte n'est pas une certitude. Une minute, votre assistant vocal exécute une commande complexe. La suivante, il trébuche sur un nom simple.

Ce n'est pas juste un coup de chance. C'est le résultat de conditions du monde réel qui interfèrent, mettant au défi même les modèles d'IA les plus intelligents.

Pensez-y ainsi : un outil de transcription par IA est comme une personne qui essaie de suivre une conversation. Dans une bibliothèque silencieuse, elle captera chaque mot. Mais mettez cette même personne dans un café bruyant avec des bavardages en arrière-plan et des plats qui s'entrechoquent, et elle manquera des choses. C'est exactement le même principe pour une IA.

L'audio immaculé, de qualité laboratoire utilisé pour les tests est à des années-lumière de l'audio désordonné et imprévisible de notre vie quotidienne. Maîtriser ces facteurs d'influence est la première étape pour comprendre pourquoi votre précision pourrait être erronée et définir des attentes réalistes pour vos transcriptions.

La qualité de votre source audio

C'est le point crucial. Le facteur le plus important pour une transcription précise est la qualité de l'audio que vous fournissez à la machine. C'est le scénario classique "garbage in, garbage out". Un enregistrement propre et net donne à l'IA des données claires avec lesquelles travailler, tandis qu'un audio médiocre la force à faire des suppositions éclairées.

Plusieurs éléments contribuent à la qualité globale de l'audio :

-

Qualité du microphone : Ce micro intégré à votre ordinateur portable ? À l'autre bout de la pièce, il capte un son fin et réverbérant. Un microphone externe dédié placé près du locuteur, en revanche, délivre un signal riche et clair qui fait toute la différence.

-

Environnement acoustique : Enregistrer dans une pièce avec de nombreuses surfaces dures — pensez aux murs en verre et aux sols carrelés — crée de l'écho et de la réverbération qui brouillent le son. Cela perturbe l'IA. Les meubles rembourrés comme les tapis, les rideaux et même les bibliothèques sont vos amis ici ; ils absorbent ces ondes sonores.

-

Compression audio : Lorsque vous compressez fortement un fichier audio, vous supprimez les détails phonétiques subtils pour réduire la taille du fichier. Cette perte d'informations rend beaucoup plus difficile pour l'IA de faire la différence entre des mots qui sonnent de manière similaire comme "peut" et "ne peut pas".

Naviguer dans les environnements bruyants et les différences de locuteurs

Au-delà des spécifications techniques de votre enregistrement, le contexte de la parole elle-même joue un rôle majeur. Le bruit de fond est l'ennemi public numéro un. Des études ont montré à maintes reprises que même un bruit modéré peut sérieusement faire chuter votre taux de précision.

Imaginez essayer de transcrire un appel d'un centre de support client animé. L'IA doit distinguer la voix d'une personne d'une mer d'autres agents qui parlent, de téléphones qui sonnent et de claviers qui tapent. C'est un défi énorme. C'est pourquoi isoler l'audio du locuteur principal est si crucial pour obtenir des transcriptions utilisables.

Une étude sur la façon dont différents modèles d'IA gèrent le bruit de fond a révélé qu'un modèle leader produisait 73 % moins de sorties erronées dues au bruit par rapport à un concurrent. Cela souligne à quel point la technologie de gestion du bruit d'un modèle est vitale pour la précision dans le monde réel.

Mais il ne s'agit pas seulement du bruit. Une multitude de facteurs liés au locuteur entrent en jeu :

-

Accents et dialectes : La plupart des modèles d'IA sont entraînés sur d'énormes ensembles de données, mais ils peuvent toujours avoir un accent "par défaut". Un accent régional prononcé introduit des particularités phonétiques que l'IA n'a peut-être pas été entraînée à reconnaître.

-

Plusieurs locuteurs : C'est difficile. Lorsque les gens se parlent par-dessus, leurs voix se mélangent littéralement en une seule onde sonore. Essayer de démêler qui a dit quoi est l'un des problèmes les plus difficiles en transcription.

-

Rythme et diction : Les personnes qui parlent vite et celles qui marmonnent sont aussi difficiles à comprendre pour une IA que pour nous. Une diction claire est essentielle.

-

Terminologie spécialisée : Une IA ne connaîtra pas magiquement les acronymes internes de votre entreprise ou le jargon technique complexe. Elle ne connaît que ce sur quoi elle a été entraînée. C'est là que des fonctionnalités comme les vocabulaires personnalisés deviennent un atout majeur.

Comparaison de la transcription par IA avec les experts humains

Lorsqu'il est temps de transcrire de l'audio, vous êtes confronté à une décision importante : optez-vous pour une IA sophistiquée ou un professionnel humain expérimenté ? La vraie réponse n'est pas de savoir lequel est "meilleur" dans l'absolu, mais lequel est le bon outil pour le travail que vous avez devant vous.

C'est le match classique : vitesse automatisée contre perspicacité humaine.

La transcription par IA est votre meilleure alliée lorsque la vitesse, le coût et l'échelle sont les plus importants. Pensez à traiter des heures d'enregistrements de réunions internes ou à obtenir une ébauche rapide d'un épisode de podcast. Pour des tâches comme celles-ci, les systèmes automatisés sont dans une catégorie à part. Ils peuvent traiter d'énormes quantités d'audio en quelques minutes, pas en jours, et ils le font pour une fraction infime de ce que coûterait un service humain. Cela fait de l'IA une évidence pour le contenu à grand volume et à faible enjeu où "assez bon" est vraiment tout ce dont vous avez besoin.

Mais la conversation sur la précision devient beaucoup plus sérieuse lorsque l'objectif est la perfection. Pour un travail à enjeux élevés — pensez aux dépositions juridiques, à la dictée médicale ou aux entretiens approfondis d'études de marché — les experts humains sont toujours les champions incontestés.

Là où les humains ont encore l'avantage

Un transcripteur humain professionnel fait bien plus que simplement taper des mots. Il comprend le contexte, la nuance et l'intention derrière ce qui est dit. Cette touche humaine est essentielle pour naviguer dans les situations délicates qui font trébucher constamment l'IA.

-

Gestion de l'ambiguïté : Les humains peuvent démêler les conversations qui se chevauchent, déterminer qui parle, et capter le sarcasme ou les changements subtils de ton qu'un algorithme ne calcule tout simplement pas.

-

Navigation dans les audios de mauvaise qualité : L'IA abandonne face à un bruit de fond important ou à des accents prononcés. Un humain, en revanche, peut souvent écouter au-delà du bruit statique et extraire les mots voulus.

-

Garantie de la précision verbatim : Dans les contextes juridiques et médicaux, chaque mot, chaque pause et chaque "euh" peut être d'une importance capitale. Les humains fournissent une transcription verbatim fidèle que les machines ne peuvent pas reproduire avec une fidélité parfaite.

Ce n'est pas juste une impression, les chiffres le confirment. Alors que certains outils d'IA affichent une précision d'environ 86 % dans un laboratoire parfait et silencieux, leurs performances dans le monde réel sont plus proches de 61,92 %. En revanche, un transcripteur humain professionnel atteint constamment près de 99 % de précision. C'est une différence énorme lorsque les détails comptent vraiment.

Pour vous aider à visualiser les compromis, voici un bref aperçu de la façon dont la transcription par IA et humaine se comparent.

Comparaison directe IA vs Transcription humaine

Ce tableau présente les principales différences pour vous aider à décider quel service correspond le mieux aux besoins de votre projet.

Fonctionnalité | Transcription par IA | Transcription humaine |

|---|---|---|

Vitesse | Extrêmement rapide, livrant souvent des transcriptions en quelques minutes. | Plus lent, prenant généralement des heures ou des jours selon la durée de l'audio. |

Coût | Très bas, généralement facturé à la minute ou via un abonnement. | Significativement plus élevé, facturé à la minute d'audio. |

Précision | Variable, allant de 60 à 90 %. Lutte avec le bruit, les accents et le jargon. | Très élevé, constamment autour de 99 %. |

Conscience contextuelle | Manque de compréhension de la nuance, du sarcasme ou de l'intention du locuteur. | Excellent pour interpréter le contexte, l'émotion et identifier différents locuteurs. |

Gestion des audios de mauvaise qualité | Lutte considérablement avec le bruit de fond, les dialogues croisés et la faible qualité. | Beaucoup plus capable de déchiffrer les audios difficiles. |

Idéal pour | Réunions internes, ébauches, archives consultables, contenu à grand volume. | Procès, dossiers médicaux, études de marché, publication et contenu public. |

En fin de compte, le meilleur choix dépend de ce que vous êtes prêt à échanger : vitesse et coût contre précision et nuance quasi parfaites.

Choisir la bonne méthode de transcription

Votre décision se résume vraiment aux besoins de votre projet et à la marge d'erreur dont vous disposez. Vous avez besoin d'une version texte rapide et consultable d'une conférence ? L'IA est votre réponse. Vous avez besoin d'un enregistrement sans faille d'un témoignage sous serment pour une affaire judiciaire ? Un expert humain est la seule voie à suivre. Pour vraiment apprécier l'état actuel des capacités linguistiques de l'IA, il est intéressant de consulter des analyses comme la performance de Google Translate au test de Turing.

Dans de nombreux cas, l'approche la plus intelligente est une approche hybride. De nombreux flux de travail modernes commencent maintenant par une transcription rapide générée par IA pour obtenir une première ébauche. Ensuite, un éditeur humain intervient pour corriger les erreurs, ajouter la nuance nécessaire et s'assurer que la version finale est polie à la perfection.

Étapes concrètes pour améliorer vos résultats de transcription

Au lieu de vous résigner à des transcriptions erronées, vous pouvez prendre le contrôle et améliorer sérieusement votre précision de parole au texte. L'optimisation de votre processus d'enregistrement et l'aide à l'IA dès le départ peuvent considérablement améliorer vos résultats.

Quelques petits ajustements au début vous éviteront des heures d'édition fastidieuse plus tard.

Pensez-y comme donner des indications à quelqu'un. Vous pourriez marmonner d'une pièce bruyante en espérant le meilleur, ou vous pourriez parler clairement et lui donner une carte. La deuxième approche fonctionnera toujours mieux, et la même logique s'applique à l'IA de transcription.

Contrôlez votre environnement d'enregistrement

Les gains les plus faciles en matière de précision de transcription commencent par votre audio source. Avant même de penser à appuyer sur "enregistrer", prenez un moment pour vous mettre en position de réussite. Cela a moins à voir avec du matériel de studio coûteux et plus à voir avec quelques choix intelligents et simples.

Tout d'abord, éliminez le bruit de fond. Une pièce silencieuse est non négociable. Cela signifie éteindre les ventilateurs, faire taire votre téléphone et fermer la fenêtre. Même un léger bourdonnement que vous pourriez ne pas remarquer peut suffire à perturber l'IA et à introduire des erreurs.

Ensuite, rapprochez-vous de votre microphone. Que vous utilisiez un microphone USB professionnel ou simplement celui de votre téléphone, réduire la distance entre votre bouche et le microphone est la chose la plus efficace que vous puissiez faire pour la clarté audio. Cela fait de votre voix la star du spectacle, pas l'écho de la pièce.

La précision d'un modèle d'IA n'est aussi bonne que les données qu'il reçoit. En fournissant un audio propre et clair, vous n'espérez pas seulement une meilleure transcription, vous guidez activement l'IA vers le bon résultat dès le départ.

Pour tirer le meilleur parti de votre audio, maîtrisez ces domaines clés :

-

Investissez dans un microphone décent : Vous seriez étonné du saut de qualité que vous obtenez d'un microphone USB externe par rapport à n'importe quel microphone intégré d'ordinateur portable ou de webcam.

-

Réduisez l'écho de la pièce : Enregistrez dans un espace avec des surfaces douces. Les tapis, les rideaux et même un placard rempli de vêtements font des merveilles pour absorber le son et prévenir cet effet creux et réverbérant.

-

Parlez clairement et de manière cohérente : Essayez d'éviter de parler trop vite ou de marmonner. Un rythme régulier et naturel et une diction claire donnent à l'IA une bien meilleure chance de bien faire les choses.

Améliorer la précision de la transcription par IA

Après avoir assuré la clarté de votre audio, vous pouvez encore améliorer la précision de la transcription en fournissant à l'IA un contexte pertinent. Bien que les outils de transcription modernes soient très avancés, ils pourraient ne pas être familiers avec vos acronymes spécifiques, les noms de marque ou le jargon technique. C'est là que votre contribution devient précieuse.

De nombreuses plateformes comme Transcript LOL offrent la possibilité de créer un vocabulaire personnalisé. En fournissant à l'IA une liste de mots uniques ou moins courants qu'elle pourrait rencontrer, vous améliorez sa capacité à les reconnaître avec précision. Inclure des termes comme "SaaS", "ROI" ou les noms de projets de votre entreprise aide le modèle à les identifier correctement à chaque fois.

Transcriptions précises

IA de pointe

Alimenté par Whisper d'OpenAI pour une précision de premier plan. Prise en charge des vocabulaires personnalisés, des fichiers jusqu'à 10 heures et des résultats ultra rapides.

Détection des intervenants

Identifiez automatiquement les différents intervenants dans vos enregistrements et étiquetez-les avec leurs noms.

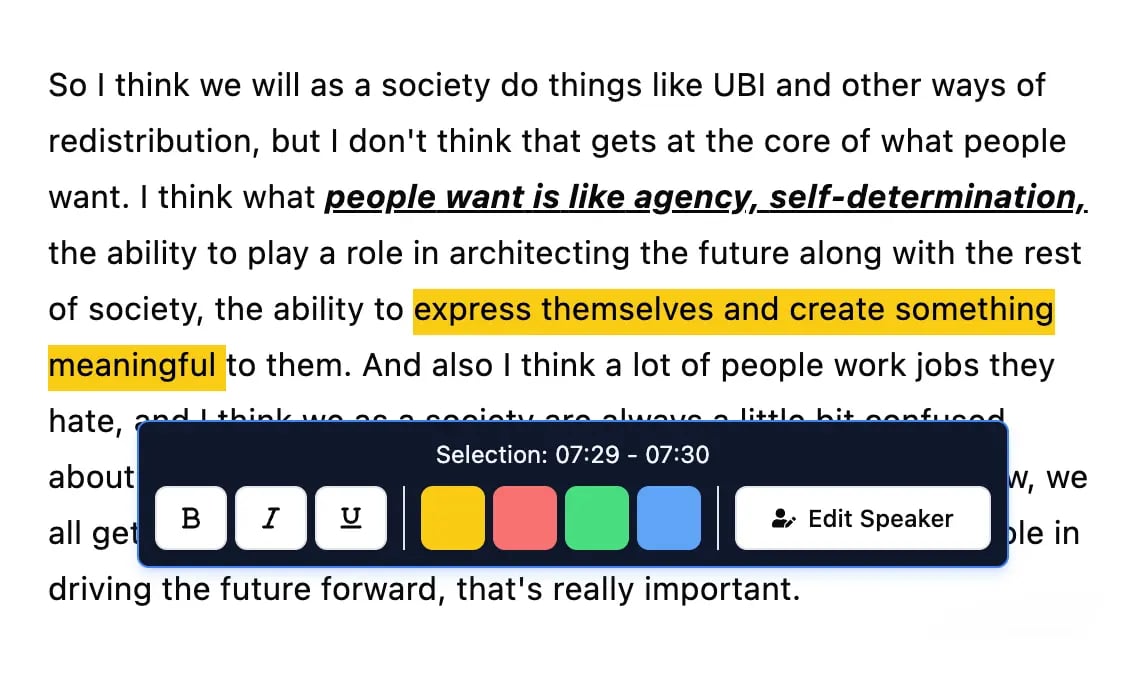

Outils d'édition

Modifiez les transcriptions avec des outils puissants incluant rechercher et remplacer, attribution des intervenants, formats de texte enrichi et surlignage.

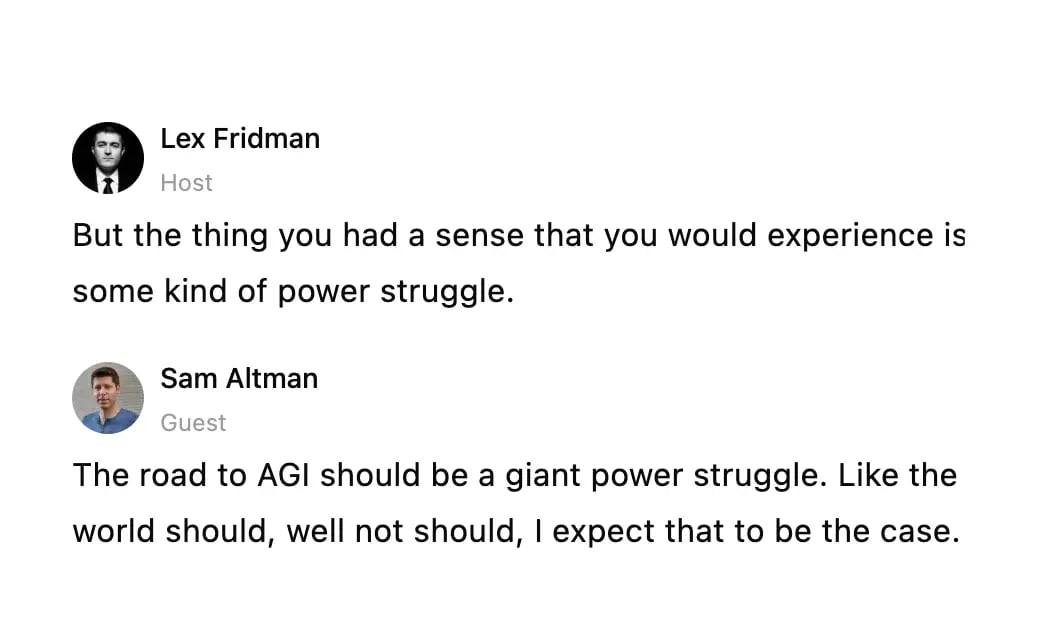

Une autre fonctionnalité précieuse est la diarisation des locuteurs (également appelée étiquetage des locuteurs). Elle identifie qui parle et quand, ce qui la rend incroyablement utile pour trier les dialogues lors de réunions ou d'entretiens. Le résultat est une transcription claire et lisible où chaque ligne est correctement attribuée au locuteur. Cette fonctionnalité est essentielle pour réutiliser des interviews ou pour des applications où la clarté du locuteur est nécessaire.

Pour maximiser vos résultats, envisagez d'explorer des logiciels de transcription qui incluent ces fonctionnalités avancées. Cette approche proactive garantit que vous générez des transcriptions fiables et crée un flux de travail transparent pour la création de contenu. Le meilleur logiciel de transcription de réunions vous guidera vers des outils qui prennent en charge ces améliorations.

L'avenir de la précision de la reconnaissance vocale

Le parcours de la précision de la reconnaissance vocale est tout simplement incroyable. Pensez-y : les premiers systèmes pouvaient à peine distinguer quelques mots, tandis que les modèles actuels peuvent naviguer dans des conversations complexes et rapides avec une compétence qui semble presque humaine. Ce bond en avant est entièrement dû à des ensembles de données massifs et aux modèles d'apprentissage profond de plus en plus intelligents qui repoussent sans cesse les limites.

En regardant en arrière, vous pouvez tracer une ligne droite des années 1950 à aujourd'hui, reliant la puissance de calcul directement aux performances. Le tout premier système, une machine nommée Audrey en 1952, pouvait reconnaître des chiffres uniques d'un seul locuteur avec plus de 90 % de précision – une affaire énorme à l'époque. Aujourd'hui, les meilleurs systèmes commerciaux peuvent atteindre un plafond de 95 % de précision dans des conditions parfaites.

Mais "conditions parfaites" est la phrase clé. Les taux d'erreur peuvent toujours fluctuer considérablement, passant de presque sans faille sur un vocabulaire petit et prévisible à un taux d'erreur frustrant de 45 % sur un vocabulaire massif et imprévisible. Cela montre simplement combien de défis restent à résoudre.

Au-delà des mots, vers une véritable compréhension

À l'avenir, le prochain grand obstacle ne consiste pas seulement à réduire le taux d'erreur sur les mots. Il s'agit d'apprendre aux machines à atteindre une compréhension authentique – à saisir toutes les couches subtiles et humaines de la communication qui ont toujours été hors de portée.

Cela signifie une attaque frontale contre des problèmes très complexes, tels que :

-

Nuance émotionnelle : L'IA peut-elle faire la différence entre l'enthousiasme sincère et le sarcasme mordant en se basant uniquement sur le ton vocal ?

-

Conscience contextuelle : Comprend-elle la blague interne, l'idiome ou le rappel de quelque chose mentionné il y a dix minutes ?

-

Le désordre du monde réel : Dans quelle mesure peut-elle gérer un chien qui aboie, une sirène qui hurle ou deux personnes qui se parlent accidentellement en même temps ?

Le véritable objectif est de combler enfin l'écart entre la simple transcription et la véritable compréhension. L'avenir n'est pas seulement une IA qui entend des mots ; c'est une IA qui comprend le sens, l'intention et le sentiment qui se cachent derrière eux, tout comme nous le faisons.

Cette quête d'une compréhension plus approfondie est ce qui alimentera la prochaine vague d'outils sophistiqués. Par exemple, l'efficacité de la technologie de réceptionniste IA dépend de sa capacité à traiter les demandes vocales sans le moindre accroc. À mesure que ces modèles deviendront meilleurs pour comprendre ce que nous voulons vraiment dire, ces outils deviendront complètement transparents.

Questions fréquentes sur la précision de la transcription

Lorsque vous commencez à vous pencher sur la reconnaissance vocale, vous rencontrerez inévitablement quelques questions pratiques. Peu importe que vous l'utilisiez pour la première fois ou que vous transcriviez depuis des années – comprendre les petits détails vous aide à savoir à quoi vous attendre et, plus important encore, comment obtenir de meilleurs résultats.

Clarifions certaines des questions les plus courantes que nous entendons.

Quel est un bon score de précision de la reconnaissance vocale ?

C'est la question principale, et la réponse honnête est toujours : cela dépend de ce pour quoi vous en avez besoin. Il n'y a pas de nombre unique qui définisse une "bonne" précision. Tout dépend de ce qui convient à votre travail spécifique.

-

Pour vos propres notes ou une première ébauche : Une précision de 80 à 85 % est souvent plus que suffisante. Vous obtiendrez les points principaux et les points clés sans avoir besoin de perfection.

-

Pour du contenu public comme des articles de blog ou des légendes vidéo : Ici, vous voudrez viser 95 % ou plus. Cela nécessitera toujours une retouche humaine, mais le gros du travail sera fait.

-

Pour des transcriptions juridiques ou médicales : Le summum est 99 % ou plus. Dans ces domaines, une seule erreur peut avoir des implications énormes, donc la précision est non négociable.

Un "bon" score ne consiste pas à atteindre un chiffre magique. Il s'agit de savoir si la transcription fait son travail sans vous obliger à des heures d'édition fastidieuse.

Pourquoi les scores de précision varient-ils autant ?

Vous avez déjà téléchargé deux fichiers audio différents sur le même outil et obtenu des scores de précision complètement différents ? Ce n'est pas un bug ; c'est juste comme ça que cette technologie fonctionne.

Les performances d'une IA sont un reflet direct de la qualité audio que vous lui fournissez.

Un podcast d'une clarté cristalline avec un seul locuteur utilisant un microphone de qualité peut dépasser 95 % de précision. Mais prenez un appel de conférence bruyant avec des gens qui se parlent par-dessus et utilisent du jargon industriel, et vous pourriez avoir de la chance d'atteindre 75 %. L'IA n'est aussi bonne que le matériel source.

Si vous avez d'autres questions, notre page complète de FAQ sur les services de transcription détaille encore plus.

Prêt à transformer votre audio et votre vidéo en texte clair et exploitable ? Transcript.LOL fournit des transcriptions rapides et très précises alimentées par l'IA avec les fonctionnalités dont vous avez besoin pour faire le travail correctement. Commencez gratuitement dès aujourd'hui sur https://transcript.lol.