Top 10 Methoden der qualitativen Datenanalyse für Forscher...

Entdecken Sie 10 leistungsstarke Methoden der qualitativen Datenanalyse. Dieser Leitfaden behandelt thematische Analyse, Grounded Theory, Inhaltsanalyse und mehr mit praktischen Beispielen.

Kate, Praveen

August 7, 2025

Qualitative Daten, von Interviewtranskripten bis hin zu Fokusgruppendiskussionen, sind reich an menschlichen Geschichten, nuancierten Meinungen und komplexen sozialen Dynamiken. Aber wie verwandelt man dieses Wortmeer in klare, umsetzbare Erkenntnisse? Der Schlüssel liegt in der Wahl des richtigen analytischen Ansatzes. Während leistungsstarke KI-Tools Ihre Audio- und Videoaufnahmen sofort transkribieren können, beginnt die eigentliche Reise, wenn Sie strukturierte qualitative Datenanalysemethoden anwenden, um die Bedeutung im Inneren aufzudecken.

Dieser Leitfaden stellt zehn wesentliche Methoden vor, die jeweils eine einzigartige Linse bieten, um Ihre Daten zu interpretieren, kritische Muster zu identifizieren und eine überzeugende Erzählung aus Ihrer Forschung zu erstellen. Wir gehen über die Theorie hinaus und liefern für jedes Framework spezifische, umsetzbare Schritte, um sicherzustellen, dass Sie diese Techniken direkt auf Ihre eigene Arbeit anwenden können.

Ob Sie ein Marktforscher sind, der Kundenfeedback analysiert, ein Journalist, der eine Geschichte zusammensetzt, oder ein Student, der sein erstes großes Projekt navigiert, dieser Überblick wird Sie mit dem Wissen ausstatten, um die perfekte Methode auszuwählen und zu implementieren. Durch die Beherrschung dieser Ansätze können Sie sicherstellen, dass Ihre Ergebnisse sowohl rigoros als auch wirkungsvoll sind. Lassen Sie uns die Frameworks erkunden, die Rohdaten in tiefgreifendes Verständnis verwandeln.

1. Thematische Analyse

Die thematische Analyse ist eine der grundlegendsten und flexibelsten Methoden der qualitativen Datenanalyse, die sich auf die Identifizierung, Analyse und Berichterstattung von Mustern (oder "Themen") innerhalb eines Datensatzes konzentriert. Popularisiert von Virginia Braun und Victoria Clarke, bietet sie einen systematischen, aber anpassungsfähigen Ansatz zum Verständnis komplexer qualitativer Daten wie Interviewtranskripte oder Fokusgruppendiskussionen.

Der Prozess beinhaltet eine tiefe Vertrautheit mit den Daten, gefolgt von der Generierung erster Codes, die interessante Merkmale darstellen. Diese Codes werden dann zu potenziellen Themen zusammengefasst, die überprüft, verfeinert und definiert werden. Das Ergebnis ist eine reiche, detaillierte und nuancierte Darstellung der Daten.

Wann ist thematische Analyse anzuwenden?

Diese Methode ist ideal, wenn Sie die Erfahrungen, Ansichten und Wahrnehmungen von Menschen verstehen müssen. Zum Beispiel könnte ein Marketingteam sie verwenden, um Transkripte von Kundenfeedback zu analysieren, um Schlüsselthemen im Zusammenhang mit Produktzufriedenheit und Markenwahrnehmung zu identifizieren. Ebenso nutzen Gesundheitsforscher sie, um Patientenberichte über das Leben mit einer chronischen Krankheit zu untersuchen und gemeinsame Herausforderungen und Bewältigungsmechanismen aufzudecken.

Umsetzbare Tipps zur Implementierung

- Entwickeln Sie ein Codebuch: Erstellen Sie ein detailliertes Codebuch, das jeden Code und jedes Thema definiert. Dieses Dokument ist entscheidend für die Aufrechterhaltung der Konsistenz, insbesondere bei der Arbeit in einem Team.

- Verwenden Sie einen induktiven oder deduktiven Ansatz: Entscheiden Sie, ob Ihre Themen direkt aus den Daten entstehen (induktiv) oder von einem bereits bestehenden theoretischen Rahmen geleitet werden (deduktiv).

- Stellen Sie die Zuverlässigkeit sicher: Implementieren Sie Inter-Rater-Zuverlässigkeitsprüfungen, bei denen mehrere Forscher dieselbe Datenprobe unabhängig voneinander kodieren und dann die Ergebnisse vergleichen. Dies stärkt die Gültigkeit Ihrer Ergebnisse.

- Führen Sie einen Audit-Trail: Dokumentieren Sie jede Entscheidung, die während des Analyseprozesses getroffen wurde. Diese Transparenz macht Ihre Forschung glaubwürdiger und leichter reproduzierbar.

Die thematische Analyse bietet einen klaren, zugänglichen Weg, um die Geschichten aufzudecken, die in Ihren qualitativen Daten verborgen sind. Für einen tieferen Einblick in die praktischen Schritte können Sie mehr über die Analyse qualitativer Daten erfahren und diese Techniken effektiv anwenden.

2. Grounded Theory

Die Grounded Theory ist eine systematische Methode der qualitativen Datenanalyse, die zur Entwicklung von Theorien verwendet wird, die auf Daten "gegründet" sind. Entwickelt von den Soziologen Barney Glaser und Anselm Strauss, beinhaltet sie die gleichzeitige Sammlung und Analyse von Daten. Anstatt mit einer Hypothese zu beginnen, lässt der Forscher theoretische Konzepte organisch aus den Daten durch einen Prozess des ständigen Vergleichs und der Iteration entstehen.

Dieser iterative Prozess beinhaltet ein Hin- und Herbewegen zwischen Datenerhebung und Analyse, wobei jede Phase die nächste informiert. Das Endziel ist nicht nur die Beschreibung eines Phänomens, sondern die Generierung eines erklärenden Rahmens, der die Kernprozesse erklärt, die innerhalb der Daten beobachtet werden.

Wann ist Grounded Theory anzuwenden?

Diese Methode eignet sich am besten für Forschungsfragen, bei denen wenig über ein Phänomen bekannt ist oder wenn bestehende Theorien unzureichend sind. Zum Beispiel könnte ein Soziologe sie verwenden, um eine neue Theorie des organisatorischen Wandels zu entwickeln, indem er die internen Dynamiken eines Unternehmens untersucht. Ebenso können Krankenpflegewissenschaftler sie verwenden, um ein theoretisches Modell von Patientenbewältigungsmechanismen auf der Grundlage von Tiefeninterviews zu erstellen.

Umsetzbare Tipps zur Implementierung

- Sofort kodieren: Beginnen Sie mit dem Kodieren, sobald Sie Ihr erstes Datenelement gesammelt haben. Dies ermöglicht es den ersten Erkenntnissen, die nachfolgenden Datenerhebungsbemühungen zu leiten.

- Häufig Memos schreiben: Schreiben Sie regelmäßig detaillierte Memos, um Ihre Gedanken, aufkommenden Konzepte und die Beziehungen festzuhalten, die Sie zwischen verschiedenen Codes beobachten.

- Theoretisches Sampling verwenden: Wählen Sie gezielt neue Teilnehmer oder Datenquellen aus, die helfen können, Ihre entstehende Theorie zu testen, zu verfeinern und zu elaborieren.

- Kodierungsphasen beibehalten: Halten Sie eine klare Unterscheidung zwischen offenen (Identifizierung von Konzepten), axialen (Beziehung von Kategorien) und selektiven (Integration und Verfeinerung der Theorie) Kodierungsphasen ein.

Die Grounded Theory bietet eine rigorose Struktur für die Erstellung neuer theoretischer Erkenntnisse direkt aus Ihren Daten. Um ihre Anwendung mit spezifischen Datentypen besser zu verstehen, können Sie die Schritte zur Analyse von Interviewdaten durch diese Linse erkunden.

Warum genaue Transkription in der Grounded Theory Forschung wichtig ist

Modernste KI

Angetrieben von OpenAIs Whisper für branchenführende Genauigkeit. Unterstützung für benutzerdefinierte Vokabulare, bis zu 10 Stunden lange Dateien und ultraschnelle Ergebnisse.

Aus mehreren Quellen importieren

Importiere Audio- und Videodateien aus verschiedenen Quellen, einschließlich direktem Upload, Google Drive, Dropbox, URLs, Zoom und mehr.

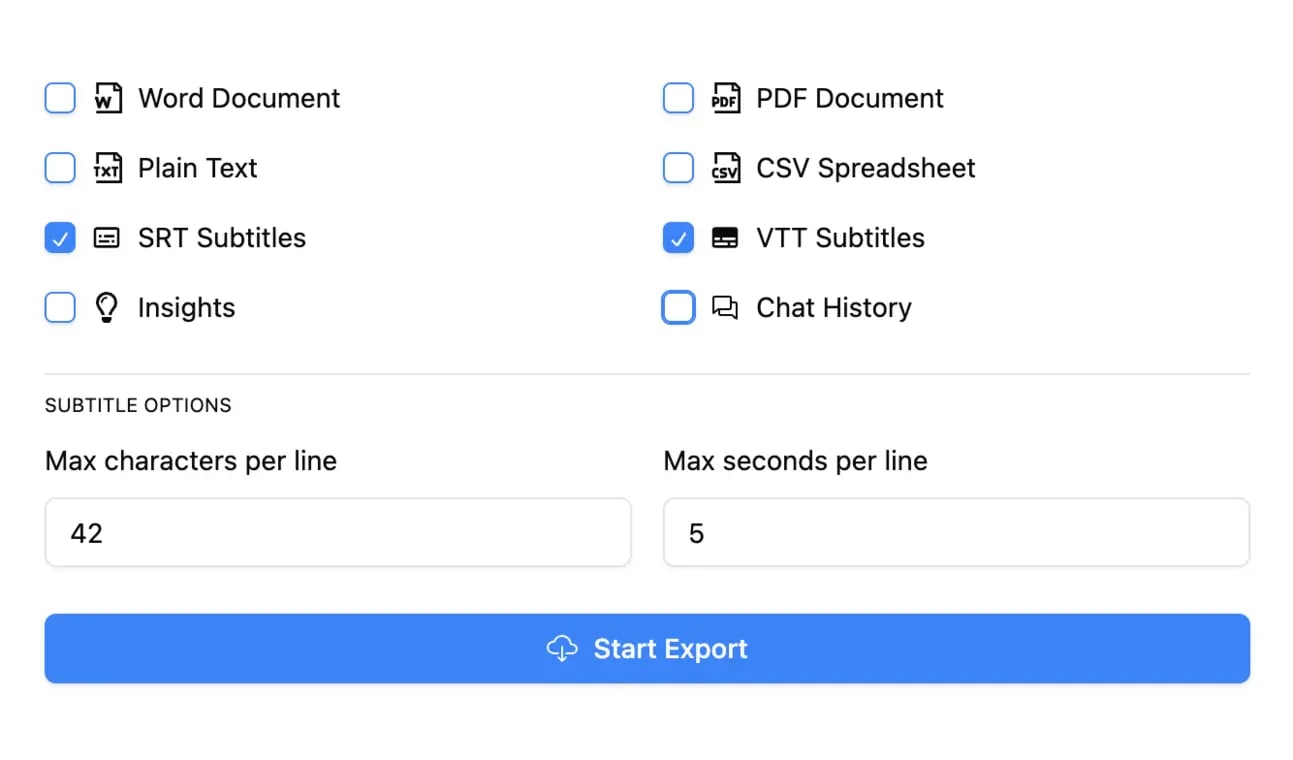

In mehreren Formaten exportieren

Exportiere deine Transkripte in mehreren Formaten, einschließlich TXT, DOCX, PDF, SRT und VTT mit anpassbaren Formatierungsoptionen.

3. Inhaltsanalyse

Inhaltsanalyse ist eine systematische Forschungsmethode, die verwendet wird, um die Präsenz, Bedeutungen und Beziehungen spezifischer Wörter, Themen oder Konzepte in qualitativen Daten zu quantifizieren und zu interpretieren. Im Gegensatz zu Methoden, die sich ausschließlich auf die zugrunde liegende Bedeutung konzentrieren, überbrückt die Inhaltsanalyse oft qualitative und quantitative Ansätze, indem sie systematisch kodiert und Häufigkeiten zählt, um Muster zu identifizieren. Sie kann auf eine breite Palette von Materialien angewendet werden, darunter Text, Bilder und Video.

Der Prozess beinhaltet die Entwicklung eines Kodierschemas mit klaren Kategorien und dessen Anwendung auf den Datensatz. Forscher können dann die Häufigkeit und die Beziehungen zwischen diesen Codes analysieren. Dieser systematische Ansatz, der stark von Gelehrten wie Klaus Krippendorff beeinflusst ist, bietet eine zuverlässige Möglichkeit, Kommunikationsmuster objektiv zu analysieren.

Wann Inhaltsanalyse eingesetzt werden sollte

Diese Methode ist äußerst effektiv, wenn Sie große Mengen an Text oder Medien analysieren müssen, um Kommunikationstrends, Mediendarstellungen oder die öffentliche Meinung zu verstehen. Beispielsweise könnte ein Marketingteam Inhaltsanalysen verwenden, um Social-Media-Erwähnungen zu untersuchen und Kundenfeedback als positiv, negativ oder neutral zu kategorisieren. Ähnlich könnten Medienforscher sie verwenden, um Nachrichtenartikel zu analysieren und die Darstellung spezifischer sozialer Themen im Laufe der Zeit zu verfolgen.

Umsetzbare Tipps zur Implementierung

- Detaillierte Kodierungsrichtlinien entwickeln: Erstellen Sie ein klares und umfassendes Kodierungshandbuch, das jede Kategorie mit spezifischen Beispielen definiert. Dies ist entscheidend für die Konsistenz.

- Ihr Kodierschema testen: Testen Sie das Kodierschema pilotweise an einer kleinen Datenstichprobe, um Unklarheiten oder Probleme vor der vollständigen Implementierung zu identifizieren.

- Inter-Kodierer-Zuverlässigkeit berechnen: Lassen Sie mehrere Forscher dieselben Daten kodieren und verwenden Sie eine Metrik wie Cohens Kappa, um sicherzustellen, dass Ihre Kodierung zuverlässig ist und nicht nur die subjektive Interpretation einer einzelnen Person.

- Entscheidungsregeln dokumentieren: Führen Sie Aufzeichnungen darüber, wie Sie mit mehrdeutigen oder grenzwertigen Inhalten umgehen. Diese Transparenz stärkt die Glaubwürdigkeit Ihrer Ergebnisse.

Warum die Inhaltsanalyse saubere Daten erfordert?

Die Inhaltsanalyse stützt sich stark auf präzise Kategorisierung und Häufigkeitszählungen, was bedeutet, dass selbst kleine Transkriptionsfehler die Ergebnisse verzerren können. Die Verwendung eines Transkriptionstools mit hoher Genauigkeit stellt sicher, dass Ihr Datensatz konsistent und zuverlässig bleibt. Saubere Daten beschleunigen auch die Überprüfung der Inter-Coder-Reliabilität.

4. Phänomenologische Analyse

Die phänomenologische Analyse ist eine qualitative Datenanalysemethode, die sich tief mit den gelebten Erfahrungen von Individuen auseinandersetzt, um die Essenz eines bestimmten Phänomens zu verstehen. Verwurzelt in der Philosophie und popularisiert von Denkern wie Edmund Husserl, versucht sie aufzudecken, wie Menschen ihre Welt wahrnehmen, interpretieren und verstehen. Dieser Ansatz legt Wert auf das Verständnis der subjektiven Realität der Teilnehmer.

Der Kern dieser Methode besteht darin, dass der Forscher seine eigenen vorgefassten Meinungen "einklammert" oder beiseitelegt, um sich ganz auf die Erzählung des Teilnehmers zu konzentrieren. Durch die Analyse von Tiefeninterviews oder persönlichen Berichten identifiziert der Forscher die grundlegenden Strukturen einer Erfahrung und deckt die gemeinsamen Bedeutungen auf, die ein bestimmtes Phänomen ausmachen.

Wann phänomenologische Analyse eingesetzt werden sollte

Diese Methode eignet sich am besten für Forschungsfragen, die darauf abzielen, die Bedeutung und den Kern menschlicher Erfahrungen zu verstehen. Beispielsweise könnte ein Gesundheitsforscher sie verwenden, um die gelebte Erfahrung von Patienten zu untersuchen, die sich von einer größeren Operation erholen, und die Essenz ihrer Reise durch Schmerz, Heilung und Rehabilitation aufzudecken. Ebenso könnten Bildungsforscher sie nutzen, um die tiefgreifende Erfahrung von Studierenden der ersten Generation zu verstehen, die sich ins Universitätsleben einleben.

Umsetzbare Tipps zur Implementierung

- Reflexivität praktizieren: Führen Sie ein detailliertes Tagebuch, um Ihre eigenen Vorurteile, Annahmen und Reaktionen während des gesamten Forschungsprozesses zu dokumentieren. Diese Praxis ist entscheidend, um Ihre eigene Perspektive auszuklammern.

- Tiefeninterviews führen: Verwenden Sie offene, ausgedehnte Interviews, die den Teilnehmern Raum geben, ihre Erfahrungen detailliert zu beschreiben, ohne sie zu beeinflussen.

- Wörtliche Zitate verwenden: Präsentieren Sie Ihre Ergebnisse, indem Sie sich stark auf direkte Zitate von Teilnehmern stützen. Dies hält die Analyse in der gelebten Erfahrung verankert und stellt sicher, dass die Stimme des Teilnehmers im Mittelpunkt bleibt.

- Forschungsjournal führen: Dokumentieren Sie Ihre analytischen Erkenntnisse und Reflexionen, sobald sie auftauchen. Dieses Journal wird zu einem kritischen Teil der Daten und erfasst den Interpretationsprozess.

5. Diskursanalyse

Die Diskursanalyse ist eine qualitative Datenanalysemethode, die untersucht, wie Sprache in sozialen Kontexten funktioniert. Sie geht über die wörtliche Bedeutung von Wörtern hinaus, um zu verstehen, wie Kommunikation Überzeugungen, Realitäten und Machtdynamiken formt. Popularisiert von Denkern wie Michel Foucault und Norman Fairclough, analysiert dieser Ansatz nicht nur was gesagt wird, sondern auch wie es gesagt wird, einschließlich Grammatik, Metaphern und Gesamtstruktur.

Der Prozess beinhaltet die sorgfältige Untersuchung von Texten, Gesprächen oder anderen Kommunikationsformen, um zugrunde liegende Ideologien und soziale Strukturen aufzudecken. Er zeigt, wie Sprache genutzt wird, um Autorität aufzubauen, Zielgruppen zu überzeugen und Identitäten zu konstruieren. Das Ergebnis ist ein tiefes Verständnis der sozialen und politischen Kräfte, die in der alltäglichen Kommunikation eingebettet sind.

Wann Diskursanalyse eingesetzt werden sollte

Diese Methode ist wirkungsvoll, wenn Sie die Beziehung zwischen Sprache, Macht und sozialer Realität verstehen müssen. Beispielsweise könnte ein Medienanalyst sie verwenden, um politische Reden zu dekonstruieren und Propagandatechniken aufzudecken. Im Gesundheitswesen kann sie verwendet werden, um Arzt-Patienten-Gespräche zu analysieren und implizite Vorurteile oder Machtungleichgewichte aufzudecken, die die Versorgungsqualität beeinflussen. Sie ist auch für Vermarkter von unschätzbarem Wert, die verstehen wollen, wie Markenbotschaften Konsumentenidentitäten konstruieren.

Umsetzbare Tipps zur Implementierung

- Mehrere Ebenen untersuchen: Analysieren Sie Sprache auf verschiedenen Ebenen, von der individuellen Wortwahl und Satzstruktur bis hin zu breiteren Gesprächsverläufen und narrativen Rahmen.

- Auf das Ungesagte achten: Achten Sie genau auf Auslassungen, Schweigen und Annahmen innerhalb des Textes. Was weggelassen wird, ist oft genauso bedeutsam wie das, was explizit gesagt wird.

- Kontext ist entscheidend: Interpretieren Sie Sprache immer im spezifischen historischen, kulturellen und sozialen Kontext. Dieselben Worte können in unterschiedlichen Umgebungen völlig unterschiedliche Auswirkungen haben.

- Rhetorische Strategien studieren: Analysieren Sie die spezifischen überzeugenden Techniken, die verwendet werden. Um Ihr Verständnis von Sprache und Kommunikation zu vertiefen, kann die Erkundung von Ressourcen wie Beispiele für rhetorische Mittel die Präzision Ihrer Diskursanalyse erheblich verbessern.

6. Narrative Analyse

Die narrative Analyse ist eine qualitative Datenanalysemethode, die sich darauf konzentriert, wie Menschen durch Erzählungen Bedeutung konstruieren und ihre Erfahrungen verstehen. Anstatt Daten in isolierte Themen zu zerlegen, untersucht dieser Ansatz Geschichten als kohärente Ganze und analysiert ihre Struktur, ihren Inhalt, ihre Funktion und den Kontext, in dem sie erzählt werden. Popularisiert von Persönlichkeiten wie Jerome Bruner und Dan McAdams, behandelt sie Narrative als primäre Daten für das Verständnis menschlicher Identität und des sozialen Lebens.

Der Kernprozess beinhaltet die Identifizierung von Geschichten in Transkripten oder Texten und die Analyse von Elementen wie Handlung, Charakteren, Schauplatz und kritischen Ereignissen. Forscher untersuchen, wie der Erzähler seinen Bericht strukturiert und was dies über seine Perspektive, Werte und seinen kulturellen Rahmen verrät. Das Ergebnis ist ein tiefes Verständnis der gelebten Erfahrung eines Individuums, wie sie durch seine persönliche Geschichte vermittelt wird.

Wann narrative Analyse eingesetzt werden sollte

Diese Methode eignet sich einzigartig für die Erforschung von persönlicher Identität, Lebenserfahrungen und kulturellem Gedächtnis. Ein Soziologe könnte sie verwenden, um die Identitätsbildung von Einwanderern zu untersuchen, indem er persönliche Geschichten von Migration und Akkulturation analysiert. Im Gesundheitswesen wird sie verwendet, um Patienten-Krankheitsnarrative zu verstehen und aufzudecken, wie Individuen mit ihren medizinischen Reisen umgehen und sie verstehen. Oral-History-Projekte stützen sich ebenfalls stark auf diese Methode, um persönliche Erfahrungen von historischen Ereignissen zu bewahren und zu interpretieren.

Umsetzbare Tipps zur Implementierung

- Erzählungen fördern: Stellen Sie während der Interviews offene Fragen, die die Teilnehmer dazu anregen, vollständige Geschichten anstelle von kurzen Antworten zu teilen. Formulieren Sie Fragen zu Erfahrungen, Wendepunkten oder bedeutenden Lebensereignissen.

- Narrative Struktur analysieren: Untersuchen Sie die Struktur jeder Geschichte, einschließlich des Anfangs (Orientierung), der Mitte (komplizierende Handlung) und des Endes (Auflösung). Achten Sie genau auf Schlüsselmomente oder Wendepunkte.

- Narrativen Fluss bewahren: Verwenden Sie bei der Präsentation von Ergebnissen ausgedehnte Zitate, die die Integrität und den Fluss der ursprünglichen Geschichte bewahren. Dies hilft, die Stimme und den Kontext des Erzählers zu bewahren.

4 Stärken der Narrativen Analyse

Identitätskonstruktion

Narrative enthüllen, wie Individuen ihr Selbstverständnis konstruieren. Durch die ganzheitliche Analyse von Geschichten können Forscher zugrunde liegende Motivationen, Ängste und Transformationen aufdecken, die die Identität prägen.

Kulturelle Bedeutung

Geschichten spiegeln gemeinsame kulturelle Rahmenbedingungen wider. Die Untersuchung von Metaphern, Struktur und Handlung hilft zu erkennen, wie Kultur persönliche Erfahrungen und Weltanschauungen beeinflusst.

Emotionale Einsicht

Die Narrative Analyse bewahrt Ton, Emotion und Fortschritt und bietet ein tieferes emotionales Verständnis als die alleinige thematische Kodierung. Sie hebt Stimmungsbögen und entscheidende Wendepunkte hervor.

Reiche kontextuelle Details

Narrative bewahren den Kontext – Zeit, Ort, Beziehungen – und bieten ein vielschichtiges Verständnis gelebter Erfahrungen. Dies bewahrt Nuancen, die in rein kodierten Daten verloren gehen könnten.

- Kontext berücksichtigen: Analysieren Sie, wie breitere soziale, kulturelle und historische Kontexte die Erzählung prägen. Eine Geschichte wird niemals im luftleeren Raum erzählt; ihre Bedeutung wird gemeinsam mit ihrer Umgebung konstruiert.

Die narrative Analyse bietet ein unschätzbares Fenster in die menschliche Erfahrung, aber sie beginnt mit der genauen Erfassung der Geschichte. Sie können lernen, wie man ein Interview transkribiert, um sicherzustellen, dass jedes Detail der Erzählung für Ihre Analyse erhalten bleibt.

7. Fokusgruppenanalyse

Die Fokusgruppenanalyse ist eine qualitative Datenanalysemethode, die Daten aus Gruppendiskussionen untersucht und erfasst, wie Teilnehmer interagieren und gemeinsam Bedeutung konstruieren. Im Gegensatz zu Einzelinterviews konzentriert sich diese Methode auf die sozialen Dynamiken und gemeinsamen Verständnisse, die entstehen, wenn Menschen gemeinsam ein Thema diskutieren, und bietet Einblicke in Gruppenperspektiven und kulturelle Normen.

Die Analyse umfasst nicht nur, was gesagt wird, sondern auch, wie es gesagt wird. Forscher betrachten das Zusammenspiel zwischen den Teilnehmern, wie z. B. Übereinstimmungs- und Meinungsverschiedenheiten sowie wie Ideen aufgebaut oder in Frage gestellt werden. Ziel ist es, die kollektive Sichtweise zu verstehen und nicht isolierte Einzelmeinungen.

Wann Fokusgruppenanalyse eingesetzt werden sollte

Diese Methode ist äußerst effektiv für die Erforschung sozialer Normen und gemeinsamer Überzeugungen. Beispielsweise könnte eine Organisation für öffentliche Gesundheit sie nutzen, um zu testen, wie verschiedene Gemeinschaften eine Botschaft einer Gesundheitskampagne interpretieren und darauf reagieren werden. Ebenso nutzen Vermarkter sie, um die Reaktionen der Verbraucher auf ein neues Produktkonzept zu messen und zu beobachten, wie sich ein Konsens über Funktionen, Branding und Preisgestaltung bildet.

Umsetzbare Tipps zur Implementierung

- Homogene Gruppen rekrutieren: Um eine offene Diskussion zu fördern, rekrutieren Sie Teilnehmer mit gemeinsamen Merkmalen (z. B. Alter, Beruf). Dies hilft, Hemmungen abzubauen und die Menschen dazu zu bringen, ihre Ansichten leichter zu teilen.

- Einen nicht-leitenden Moderationsleitfaden entwickeln: Erstellen Sie einen Leitfaden mit offenen Fragen, die zur Diskussion anregen, ohne eine "korrekte" Antwort vorzuschlagen. Die Rolle des Moderators ist es, zu leiten, nicht zu führen.

- Sowohl Inhalt als auch Interaktion analysieren: Gehen Sie über die Worte hinaus. Analysieren Sie Interaktionsmuster wie wer am meisten spricht, wer unterbricht und nonverbale Hinweise. Diese Dynamiken offenbaren soziale Hierarchien und Einfluss.

- Gruppendynamiken dokumentieren: Führen Sie detaillierte Aufzeichnungen über die Zusammensetzung der Gruppe und alle spezifischen Dynamiken, die die Konversation beeinflusst haben könnten. Dieser Kontext ist entscheidend für eine genaue Interpretation.

Die Fokusgruppenanalyse ist hervorragend geeignet, um den sozialen Kontext von Meinungen aufzudecken. Für beste Ergebnisse ist eine genaue Transkription entscheidend, um diese reichen Interaktionen zu erfassen, und Sie können mehr über die Transkription für Fokusgruppen erfahren, um sicherzustellen, dass kein Detail verloren geht.

8. Fallstudienanalyse

Die Fallstudienanalyse ist eine eingehende Untersuchung eines spezifischen Falls, wie z. B. einer Person, einer Gruppe, einer Organisation oder eines Ereignisses, in seinem realen Kontext. Anstatt nach breiten Verallgemeinerungen zu suchen, bietet diese Methode ein umfassendes, ganzheitliches Verständnis komplexer Situationen. Popularisiert von Forschern wie Robert Yin, untersucht sie, wie verschiedene Faktoren interagieren, um Ergebnisse in einem bestimmten Umfeld zu beeinflussen.

Der Prozess umfasst das Sammeln detaillierter Informationen aus mehreren Quellen wie Interviews, Dokumenten und Beobachtungen, um ein reiches, vielschichtiges Profil des Falls zu erstellen. Diese Daten werden dann analysiert, um Schlüsselmuster, Beziehungen und Erkenntnisse zu identifizieren, die für diesen spezifischen Kontext einzigartig sind, was sie zu einer der leistungsfähigsten qualitativen Datenanalysemethoden für tiefgehende Erkundungen macht.

Wann Fallstudienanalyse eingesetzt werden sollte

Diese Methode ist ideal, um "Wie" und "Warum"-Fragen zu einem aktuellen Phänomen zu beantworten. Beispielsweise könnte ein Unternehmen sie nutzen, um eine erfolgreiche organisatorische Veränderungsinitiative zu analysieren und die spezifischen Strategien und kulturellen Faktoren zu untersuchen, die zu ihrem Erfolg geführt haben. In der Bildung könnten Forscher eine einzelne leistungsstarke Schule untersuchen, um die Elemente zu verstehen, die zu ihrer Effektivität beitragen.

Umsetzbare Tipps zur Implementierung

- Fallgrenzen definieren: Legen Sie vor Beginn klar den Umfang und die Grenzen Ihres Falls fest. Definieren Sie, was den Fall ausmacht und was außerhalb liegt, um den Fokus zu wahren.

- Mehrere Datenquellen nutzen: Triangulieren Sie Ihre Ergebnisse, indem Sie Daten aus verschiedenen Quellen sammeln (z. B. Interviews, Archivaufzeichnungen, direkte Beobachtung). Dies stärkt die Gültigkeit und Zuverlässigkeit Ihrer Schlussfolgerungen.

- Ein Fallstudienprotokoll entwickeln: Erstellen Sie ein formelles Protokoll, das die Verfahren für Datenerhebung und -analyse festlegt. Dieses Dokument gewährleistet Konsistenz, insbesondere wenn mehrere Forscher beteiligt sind.

- Eine Fallstudien-Datenbank pflegen: Organisieren Sie alle gesammelten Daten, Notizen, Dokumente und Transkripte in einer gut strukturierten Datenbank. Dies macht das Material für die Analyse überschaubar und zugänglich.

9. Ethnographische Analyse

Die ethnographische Analyse beinhaltet die Immersion des Forschers in eine Gemeinschaft oder ein soziales Umfeld, um deren Kultur, Verhaltensweisen und soziale Strukturen aus der Perspektive eines Insiders zu verstehen. Popularisiert von wegweisenden Anthropologen wie Bronisław Malinowski und Margaret Mead, geht diese Methode über die einfache Beobachtung hinaus und beinhaltet aktive Teilnahme, was ein tiefes, kontextbezogenes Verständnis gelebter Erfahrungen ermöglicht.

Der Prozess ist langfristig und beruht auf dem Aufbau von Beziehungen und Vertrauen innerhalb der untersuchten Gruppe. Daten werden durch detaillierte Feldnotizen, teilnehmende Beobachtung und informelle Gespräche gesammelt, was eine reiche, ganzheitliche Sicht auf die Welt der Gemeinschaft ermöglicht. Dieser Ansatz ist ein Eckpfeiler qualitativer Datenanalysemethoden, die Kontext und Kultur priorisieren.

Ethnografische Fallstricke: Überidentifikation des Forschers

Ethnografen tauchen oft tief in das Gemeinschaftsleben ein, aber eine Überidentifikation kann die Objektivität beeinträchtigen. Die Führung eines Reflexionsjournals und die regelmäßige Überprüfung von Feldannahmen helfen, zu verhindern, dass Voreingenommenheit die Schlussfolgerungen beeinflusst.

Wann ethnografische Analyse eingesetzt werden sollte

Diese Methode ist von unschätzbarem Wert, wenn Sie die unausgesprochenen Regeln, Rituale und Dynamiken einer bestimmten Gruppe verstehen müssen. Ein Organisationsforscher könnte sie nutzen, um die Arbeitsplatzkultur zu untersuchen und Hindernisse für die Zusammenarbeit zu identifizieren, während ein UX-Designer eine Ethnografie durchführen könnte, um zu sehen, wie ein Technologieprodukt in die täglichen Routinen und das Leben seiner Nutzer passt. Sie eignet sich hervorragend, um Erkenntnisse aufzudecken, die die Teilnehmer in einem formellen Interview möglicherweise nicht artikulieren können.

Umsetzbare Tipps zur Implementierung

- Reflexivität üben: Führen Sie ein separates Journal, um Ihre eigenen Vorurteile, Annahmen und emotionalen Reaktionen zu dokumentieren. Dies hilft Ihnen zu verstehen, wie Ihre Anwesenheit die Forschungsumgebung beeinflusst.

- Detaillierte Feldnotizen führen: Halten Sie sowohl beschreibende Beobachtungen (was Sie sehen und hören) als auch analytische Notizen (Ihre Interpretationen und aufkommenden Ideen) fest, um ein vollständiges Bild zu erhalten.

- Beziehungen zu wichtigen Informanten aufbauen: Identifizieren und entwickeln Sie starke Beziehungen zu kenntnisreichen Gemeindemitgliedern, die tiefere Einblicke und Zugang zu verschiedenen sozialen Kreisen bieten können.

- Teilnahme und Beobachtung ausbalancieren: Nehmen Sie aktiv am Gemeinschaftsleben teil, um eine Insider-Perspektive zu gewinnen, aber behalten Sie Ihre Rolle als Forscher im Auge, um Objektivität zu wahren.

10. Framework-Analyse (Qualitative Framework-Methode)

Die Framework-Analyse ist eine strukturierte und matrixbasierte qualitative Datenanalysemethode, die für die angewandte Politikforschung entwickelt wurde. Sie wurde von Jane Ritchie und Liz Spencer entwickelt und beinhaltet einen systematischen Ansatz, bei dem Daten in einem Rahmen von Themen und Unterthemen organisiert werden. Dies macht sie hervorragend für die Verwaltung großer Datensätze und den Vergleich von Ergebnissen über mehrere Fälle oder Teilnehmer hinweg.

Der Prozess umfasst fünf Schlüsselphasen: Vertrautmachen, Identifizieren eines thematischen Rahmens, Indexieren, Erstellen von Tabellen und Kartieren/Interpretieren. Die Daten werden systematisch zusammengefasst und in einer Matrix zusammengefasst, wodurch Forscher leicht Muster, Widersprüche und Beziehungen sowohl innerhalb als auch zwischen den Fällen identifizieren können. Dies macht sie zu einer transparenten und rigorosen Methode zur Generierung umsetzbarer Erkenntnisse.

Framework-Analyse-Tools, die die Produktivität steigern

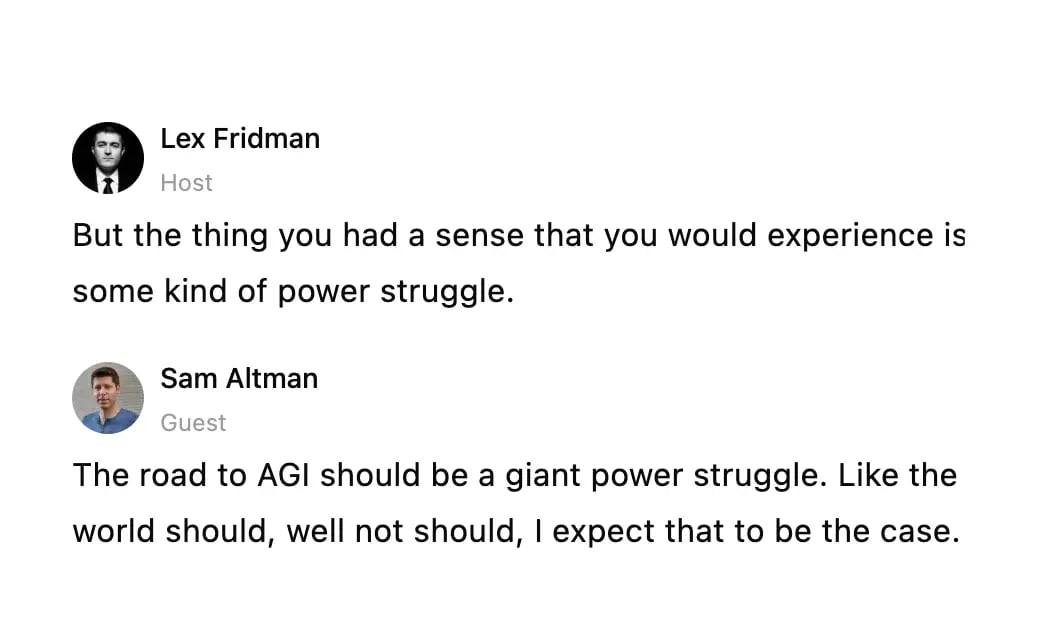

Sprechererkennung

Identifiziere automatisch verschiedene Sprecher in deinen Aufnahmen und beschrifte sie mit ihren Namen.

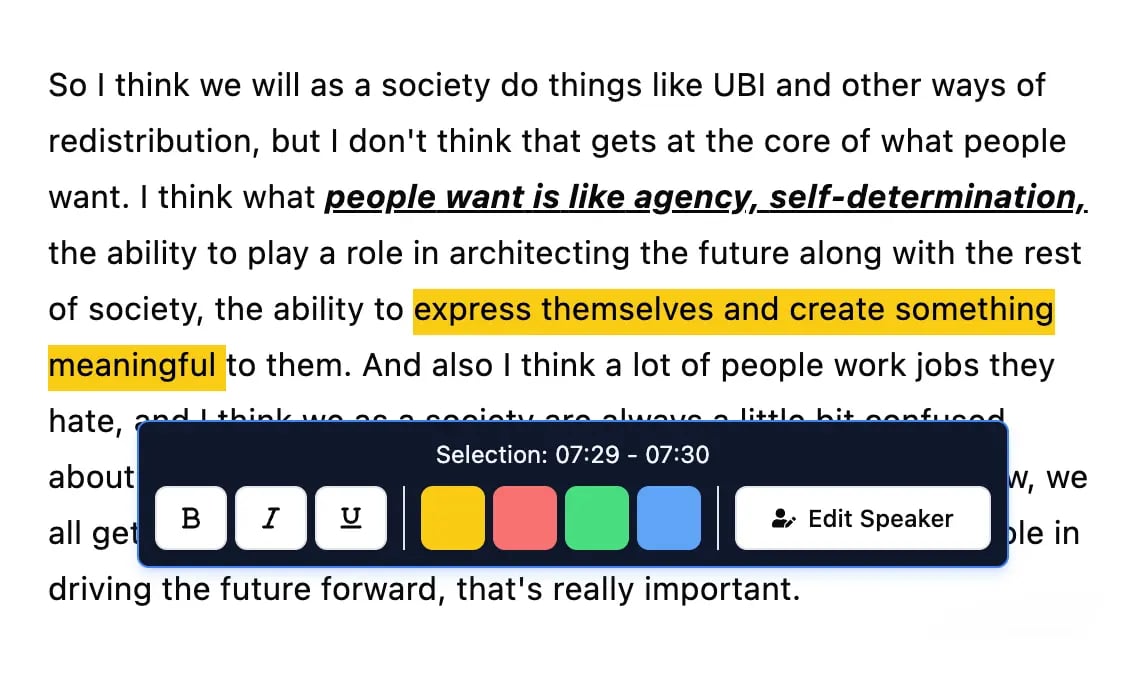

Bearbeitungswerkzeuge

Bearbeite Transkripte mit leistungsstarken Werkzeugen wie Suchen und Ersetzen, Sprecherzuordnung, Rich-Text-Formate und Hervorhebungen.

Zusammenfassungen und Chatbot

Erstelle Zusammenfassungen und andere Erkenntnisse aus deinem Transkript, wiederverwendbare benutzerdefinierte Prompts und Chatbot für deine Inhalte.

Wann Framework-Analyse verwenden

Diese Methode ist besonders wirkungsvoll in der Evaluations- und Politikforschung, wo Sie Antworten verschiedener Gruppen vergleichen oder die Wirksamkeit einer Intervention bewerten müssen. Zum Beispiel könnte ein Gesundheitsteam sie verwenden, um ein neues Patientenunterstützungsprogramm zu evaluieren, indem es Feedback aus verschiedenen Kliniken erfasst und Implementierungsprobleme sowie Patientenergebnisse systematisch vergleicht. Ebenso könnte ein Bildungsforscher Lehrmethoden verschiedener Schulen vergleichen.

Praktische Tipps zur Implementierung

- Entwickeln Sie ein kollaboratives Framework: Beziehen Sie mehrere Teammitglieder in die Erstellung des thematischen Frameworks ein. Dies stellt sicher, dass die Struktur robust, umfassend ist und vielfältige Perspektiven auf die Daten widerspiegelt.

- Pilotieren Sie Ihr Framework: Testen Sie das Framework an einer kleinen Stichprobe, bevor Sie es auf den gesamten Datensatz anwenden. Dies hilft, Unklarheiten oder Lücken in Ihren Themen zu identifizieren und ermöglicht eine Verfeinerung.

- Nutzen Sie Charting-Matrizen effektiv: Die Matrix ist das Herzstück dieser Methode. Verwenden Sie sie, um klare visuelle Übersichten zu erstellen, die Daten für jeden Fall im Verhältnis zu jedem Thema zusammenfassen und so den Fallvergleich erleichtern.

- Pflegen Sie klare Definitionen: Dokumentieren Sie präzise Definitionen und Beispiele für jeden Code und jedes Thema innerhalb Ihres Frameworks. Dies gewährleistet Konsistenz, insbesondere bei der Indizierung und Darstellung komplexer Daten.

10-Methodenvergleich: Qualitative Datenanalyse

| Methode | Komplexität der Implementierung 🔄 | Ressourcenbedarf & Geschwindigkeit ⚡ | Erwartete Ergebnisse ⭐ / Auswirkung 📊 | Ideale Anwendungsfälle | Hauptvorteile / Tipps 💡 |

|---|---|---|---|---|---|

| Thematische Analyse | Niedrig–Moderat 🔄🔄 | Moderate Ressourcen; mittlere Zeit; Codierungssoftware hilfreich ⚡⚡ | ⭐⭐⭐⭐ — Reichhaltige, beschreibende Themen; übertragbare Erkenntnisse 📊 Mittel–Hoch | Explorative Studien, Interviews, diverse Datensätze | 💡 Flexibel und zugänglich; Codebücher und Inter-Rater-Checks verwenden |

| Grounded Theory | Hoch 🔄🔄🔄 | Hohe Ressourcen; sehr zeitaufwendig; erfahrenes Team; Memoing unerlässlich ⚡ | ⭐⭐⭐⭐⭐ — Neue Theorie und Erklärungsmodelle; starke interne Kohärenz 📊 Hoch (theoretisch) | Theorieentwicklung, erklärende soziale Prozesse | 💡 Früh mit dem Codieren beginnen; häufige Memos schreiben; theoretisches Sampling verwenden |

| Inhaltsanalyse | Niedrig–Moderat 🔄🔄 | Niedrig–Moderate Ressourcen; effizient bei großen Korpora; automatisierbar ⚡⚡⚡ | ⭐⭐⭐⭐ — Systematische Zählungen und Kategorienmuster; replizierbare Ergebnisse 📊 Mittel–Hoch | Medienstudien, große Text-/Bildkorpora, Stimmungs-/Häufigkeitsanalyse | 💡 Codierschema vortesten; Inter-Coder-Reliabilität berechnen |

| Phänomenologische Analyse | Hoch 🔄🔄🔄 | Moderate–Hohe Ressourcen; Tiefeninterviews; langsame Analyse ⚡ | ⭐⭐⭐⭐ — Tiefe subjektive Einblicke in gelebte Erfahrung; geringe Generalisierbarkeit 📊 Niedrig–Mittel | Studien persönlicher Erfahrungen (Gesundheit, Trauer, Identität) | 💡 Bracketing und Reflexivität betonen; wörtliche Zitate verwenden |

| Diskursanalyse | Hoch 🔄🔄🔄 | Moderate–Hohe Ressourcen; erfordert theoretische Lektüre; detaillierte linguistische Arbeit ⚡ | ⭐⭐⭐⭐ — Enthüllt Ideologien, Machtverhältnisse; interpretative Ergebnisse 📊 Hoch für kritische Einblicke | Medien, politische Kommunikation, Macht-/Identitätsstudien | 💡 Mehrere linguistische Ebenen und kontextuelle Geschichte analysieren |

| Narrative Analyse | Moderat–Hoch 🔄🔄🔄 | Moderate Ressourcen; zeitaufwendig für strukturelle Arbeit; qualitative Werkzeuge nützlich ⚡⚡ | ⭐⭐⭐⭐ — Ganzheitliche Geschichten, die Identität und Bedeutung zeigen; eindrucksvolle Ergebnisse 📊 Mittel | Lebensgeschichten, Trauma-Bewältigung, Identitätsbildung | 💡 Erzählfluss bewahren; Wendepunkte und Chronologie analysieren |

| Fokusgruppenanalyse | Moderat 🔄🔄 | Moderate Ressourcen; effiziente Datenerhebung, aber komplexe Transkription ⚡⚡ | ⭐⭐⭐ — Gruppennormen, Konsens- und Verhandlungsmuster 📊 Mittel | Marketing, Programmevaluierung, öffentliche Einstellungen | 💡 Interaktionen aufzeichnen; sowohl Inhalt als auch Gruppendynamik analysieren |

| Fallstudienanalyse | Moderat–Hoch 🔄🔄🔄 | Hohe Ressourcen; mehrere Datenquellen und Triangulation; zeitaufwendig ⚡ | ⭐⭐⭐⭐ — Tiefe kontextbezogene Erklärungen und praktische Empfehlungen 📊 Mittel–Hoch (kontextbezogen) | Organisationswandel, Implementierungsstudien, Programmevaluierung | 💡 Fallgrenzen definieren; Quellen triangulieren; Fallprotokoll führen |

| Ethnographische Analyse | Sehr Hoch 🔄🔄🔄🔄 | Sehr hohe Ressourcen; langwierige Feldarbeit; immersives Engagement; langsam ⚡ | ⭐⭐⭐⭐⭐ — Ganzheitliches kulturelles Verständnis und Insider-Perspektive 📊 Hoch (tief kontextbezogen) | Anthropologie, Arbeitsplatzkultur, Gemeinschaftspraktiken | 💡 Detaillierte Feldforschungsnotizen führen; Reflexivität und Beziehungsaufbau praktizieren |

| Framework-Analyse | Moderat 🔄🔄 | Moderate Ressourcen; effizient für große angewandte Datensätze; Matrixarbeit beschleunigt Vergleiche ⚡⚡⚡ | ⭐⭐⭐⭐ — Transparente, prüfbare Matrizen, die den Fallvergleich ermöglichen 📊 Hoch für angewandte Evaluation | Politikbewertung, Gesundheitsdienste, angewandte Sozialforschung | 💡 Team in das Framework-Design einbeziehen; an Stichprobe testen und Regeln dokumentieren |

Auswahl Ihrer Methode und Optimierung Ihres Workflows

Die Navigation durch die Landschaft der qualitativen Datenanalysemethoden kann überwältigend sein, aber der Weg von Rohdaten zu aussagekräftigen Erkenntnissen ist ein strukturierter und lohnender Prozess. Wie wir gesehen haben, hängt der von Ihnen gewählte Weg vollständig von Ihren Forschungszielen ab. Ob Sie wiederkehrende Muster mit Thematischer Analyse identifizieren, eine neue Theorie von Grund auf mit Grounded Theory aufbauen oder gesellschaftliche Narrative mit Diskursanalyse dekonstruieren, die richtige Methode dient als Ihr Kompass und führt Sie zu glaubwürdigen und wirkungsvollen Schlussfolgerungen.

Die Stärke der qualitativen Forschung liegt in ihrer Tiefe, ihrer Fähigkeit, die Nuancen menschlicher Erfahrung zu erfassen, die Zahlen allein nicht vermitteln können. Jede Methode, vom immersiven Blickwinkel der Ethnographischen Analyse bis zum strukturierten Ansatz der Framework-Analyse, bietet eine einzigartige Möglichkeit, diese Erfahrungen zu würdigen und zu interpretieren. Der Schlüssel liegt darin, Ihre Wahl mit Ihren zentralen Forschungsfragen abzugleichen. Möchten Sie eine gelebte Erfahrung verstehen? Die Phänomenologische Analyse ist Ihr Werkzeug. Konzentrieren Sie sich auf die Bewertung eines bestimmten Programms anhand festgelegter Ziele? Die Framework-Analyse bietet die notwendige Struktur.

Wichtige Erkenntnisse für eine effektive Analyse

Um sicherzustellen, dass Ihr Analyseprozess sowohl rigoros als auch effizient ist, beachten Sie diese Kernprinzipien:

- Klarheit des Zwecks: Definieren Sie Ihre Forschungsfrage, bevor Sie beginnen. Diese einzelne Entscheidung wird beleuchten, welche der qualitativen Datenanalysemethoden am besten für Ihr Projekt geeignet ist.

- Methodische Ausrichtung: Ihre gewählte Methode ist nicht nur eine Reihe von Schritten; sie ist eine philosophische Linse. Stellen Sie sicher, dass Ihre Datenerhebungstechniken und Ihr analytischer Ansatz harmonieren, um die Integrität Ihrer Ergebnisse zu wahren.

- Iteration umarmen: Qualitative Analyse ist selten linear. Seien Sie bereit, Ihre Daten erneut zu prüfen, Ihre Codes zu verfeinern und Ihre anfänglichen Interpretationen in Frage zu stellen. In diesem iterativen Zyklus entstehen oft die tiefsten Erkenntnisse.

- Technologie nutzen: Die richtigen Werkzeuge können Ihren Workflow dramatisch optimieren. Von Datenmanagement-Software bis hin zu Transkriptionsdiensten befreit die Nutzung von Technologie Ihre kognitiven Ressourcen, damit Sie sich auf das kritische Denken und die Interpretation konzentrieren können, die nur Sie leisten können.

Optimierung Ihrer Datenvorbereitung

Ein gemeinsamer Nenner, der all diese leistungsstarken Methoden verbindet, ist die nicht verhandelbare Notwendigkeit hochwertiger, organisierter Daten. Ihre Analyse ist nur so stark wie das Fundament, auf dem sie aufgebaut ist. Für die Forschung mit Audio- oder Videoaufnahmen bedeutet dies, dass eine genaue Transkription von größter Bedeutung ist. Dieser erste Schritt stellt sicher, dass jedes Zitat, jede Zögerung und jede Interaktion originalgetreu erfasst wird und einen zuverlässigen Datensatz für die Codierung und Interpretation liefert. Darüber hinaus stellt die zunehmende Globalisierung der Forschung die Verwaltung von Daten über verschiedene Sprachen hinweg vor eine einzigartige Herausforderung. Um die Handhabung mehrsprachiger qualitativer Daten zu optimieren, insbesondere bei der Beschaffung aus digitalen Formaten, kann die Erkundung der Fähigkeiten der besten EPUB-Konverter und Übersetzungstools für mehrsprachige Forschungsdaten äußerst vorteilhaft sein.

Letztendlich verwandelt die Beherrschung dieser qualitativen Datenanalysemethoden Sie von einem einfachen Datensammler in einen Geschichtenerzähler. Sie decken das "Warum" hinter dem "Was" auf, geben komplexen menschlichen Realitäten eine Stimme und generieren Erkenntnisse, die Strategien vorantreiben, Politik informieren und unser kollektives Verständnis vertiefen können.

Bereit, ein solides Fundament für Ihre Analyse zu bauen? Lassen Sie Transcript.LOL die mühsame Arbeit der Transkription mit unübertroffener Genauigkeit und Geschwindigkeit erledigen. Beginnen Sie Ihr Projekt mit sauberen, zuverlässigen Daten und konzentrieren Sie sich auf das, was wirklich zählt: die Aufdeckung der aussagekräftigen Geschichten, die in Ihrer qualitativen Forschung verborgen sind. Testen Sie es kostenlos Transcript.LOL.