Anleitung zur Analyse qualitativer Forschungsdaten: Schritt-für-Schritt-Anleitung

Erfahren Sie, wie Sie qualitative Forschungsdaten effektiv analysieren können, mit unserer umfassenden, leicht verständlichen Anleitung. Verbessern Sie noch heute Ihre Forschungsfähigkeiten!

Kate, Praveen

December 6, 2023

Sie haben also Ihre Interviews geführt, Ihre Fokusgruppen abgeschlossen und sitzen nun auf einem Berg von Rohdaten. Was kommt als Nächstes? Hier geschieht die eigentliche Magie der qualitativen Forschung: die Umwandlung all dieser Rohdaten – Transkripte, Feldforschungsnotizen und Beobachtungen – in echte, glaubwürdige Erkenntnisse.

Der Sinn der qualitativen Analyse besteht darin, all diese nicht-numerischen Informationen systematisch zu organisieren und zu interpretieren. Es geht weniger darum, eine einzige "richtige" Antwort zu finden, als vielmehr darum, aus dem, was Ihre Teilnehmer geteilt haben, eine überzeugende, faktenbasierte Geschichte zu weben.

Die Grundlagen für eine aussagekräftige Analyse legen

Bevor Sie die Geschichte, die in Ihren Daten verborgen ist, herausarbeiten können, müssen Sie zunächst deren Sprache verstehen. Betrachten Sie die qualitative Analyse als ein interpretatives Handwerk. Sie tauchen in den Kontext, die Motivationen und die Erzählungen ein, die in Ihren Transkripten leben. Es ist eine Entdeckungsreise, keine bloße Checkliste.

Die richtige Denkweise ist entscheidend. Ich sage den Leuten immer, sie sollen sich wie ein Detektiv vorstellen, der Hinweise zusammensetzt, und nicht wie ein Wissenschaftler, der ein steriles Experiment durchführt. Ihre erste Aufgabe ist es, sich tief mit den Daten vertraut zu machen – die leichten Zögerungen in der Sprache, die immer wiederkehrenden Phrasen, die Emotionen knapp unter der Oberfläche. Diese Art von Immersion trennt eine oberflächliche Zusammenfassung von einer wirklich tiefgreifenden Analyse.

Diese Anfangsphase erfordert auch eine sorgfältige Datenvorbereitung. Sie können keinen starken Fall auf einem wackeligen Fundament aufbauen, und saubere, gut organisierte Transkripte sind dieses Fundament. Wenn Sie zum Beispiel mit Interviews arbeiten, ist die Korrektheit dieser Transkripte nicht verhandelbar. Die Nutzung eines zuverlässigen Dienstes für Ihre Transkription von Interviews und Fokusgruppen kann Ihnen eine Menge Kopfzerbrechen ersparen und verhindern, dass Sie später etwas Entscheidendes falsch interpretieren.

Kernfunktionen, die Ihnen Zeit sparen

Modernste KI

Angetrieben von OpenAIs Whisper für branchenführende Genauigkeit. Unterstützung für benutzerdefinierte Vokabulare, bis zu 10 Stunden lange Dateien und ultraschnelle Ergebnisse.

Aus mehreren Quellen importieren

Importiere Audio- und Videodateien aus verschiedenen Quellen, einschließlich direktem Upload, Google Drive, Dropbox, URLs, Zoom und mehr.

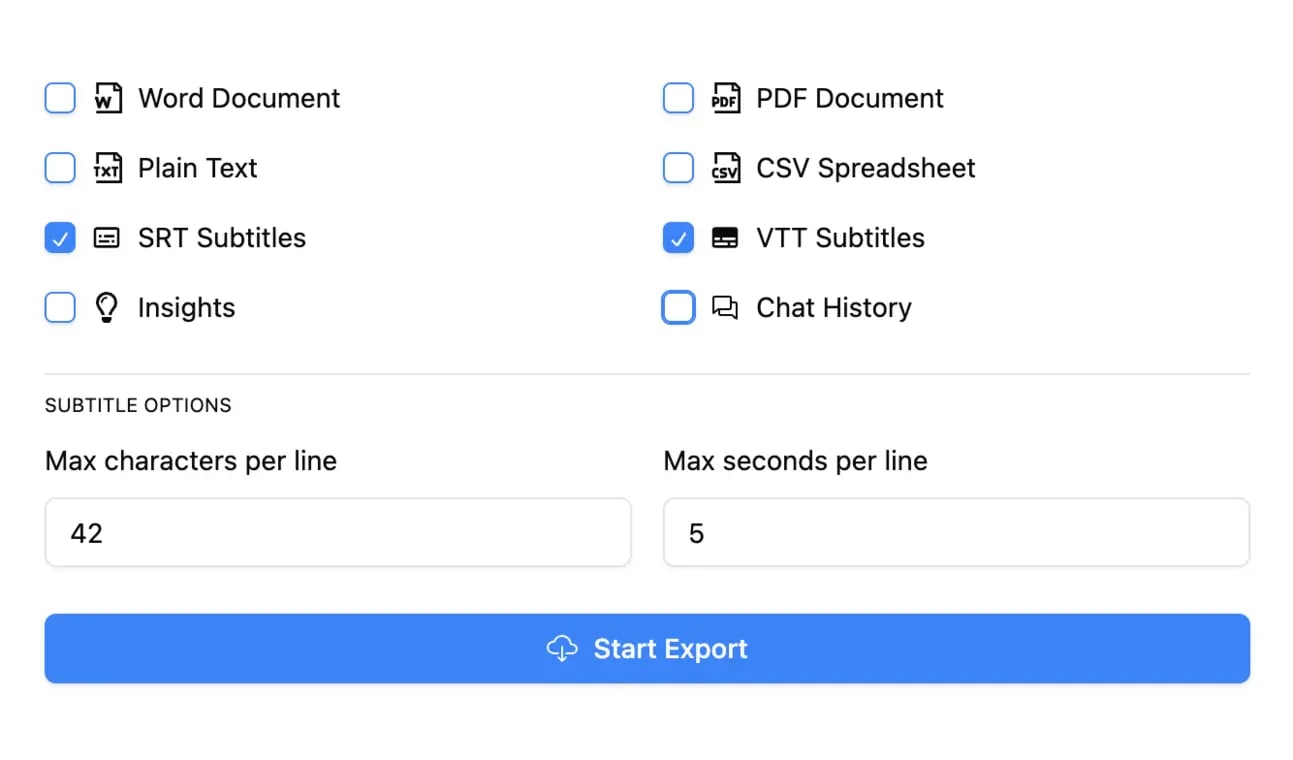

In mehreren Formaten exportieren

Exportiere deine Transkripte in mehreren Formaten, einschließlich TXT, DOCX, PDF, SRT und VTT mit anpassbaren Formatierungsoptionen.

Wahl Ihrer Methode

Sobald Ihre Daten aufbereitet und bereit sind, ist es an der Zeit, Ihren analytischen Ansatz zu wählen. Die Methode, die Sie wählen, wird Ihre Interaktion mit den Daten prägen und letztendlich die Art der Erkenntnisse bestimmen, die Sie gewinnen können.

Es ist wichtig zu bedenken, dass die qualitative Analyse nicht immer ein geradliniger Prozess ist. Sie ist oft zyklisch und iterativ, wobei Ihre frühe Analyse Sie tatsächlich dazu veranlassen kann, mehr Daten zu sammeln.

Wie dieses Diagramm zeigt, ist die Analyse nicht nur der letzte Schritt. Es ist ein fortlaufendes Gespräch mit Ihren Daten, das Ihnen hilft, Ihre Forschungsfragen im Laufe der Zeit zu verfeinern.

Es gibt viele Möglichkeiten, qualitative Daten zu zerlegen, aber die meisten Forscher greifen auf eine von fünf Kernmethoden zurück: thematische Analyse, Inhaltsanalyse, Grounded Theory, Diskursanalyse oder narrative Analyse. Jede hat einen anderen Zweck und eignet sich besser für bestimmte Forschungsziele.

Wahl Ihrer qualitativen Analysemethode

Diese Tabelle bietet einen schnellen Vergleich, der Ihnen hilft herauszufinden, welche Strategie für Ihr Projekt am sinnvollsten ist.

| Methode | Primäres Ziel | Am besten geeignet für |

|---|---|---|

| Thematische Analyse | Muster (Themen) in den Daten identifizieren und berichten. | Beantwortung der Frage: "Was sind die gemeinsamen Ideen hier?" Sehr flexibel und gut für Anfänger geeignet. |

| Inhaltsanalyse | Das Vorhandensein spezifischer Wörter oder Konzepte quantifizieren und zählen. | Beantwortung der Frage: "Wie oft wurde 'Unterstützung' negativ erwähnt?" |

| Grounded Theory | Eine neue Theorie entwickeln, die in den Daten selbst "begründet" ist. | Erforschung eines neuen Bereichs, in dem wenig Theorie existiert, und Aufbau eines Modells von Grund auf. |

| Diskursanalyse | Analysieren, wie Sprache in sozialen Kontexten verwendet wird. | Verstehen, wie Macht, Identität und soziale Normen durch Sprache konstruiert werden. |

| Narrative Analyse | Verstehen, wie Menschen Geschichten konstruieren und ihr Leben deuten. | Untersuchung individueller Erfahrungen durch die Linse einer vollständigen Geschichte (Handlung, Charaktere usw.). |

Wenn Sie sich die Zeit nehmen, die richtige Methode im Voraus zu wählen, wird der gesamte Prozess strukturierter und überschaubarer. Dies stellt sicher, dass Ihre Analyse direkt auf Ihre Forschungsziele abzielt.

Wichtige Erkenntnisse für Forscher

Denken Sie daran, dass die qualitative Analyse iterativ ist. Ihre frühen Ergebnisse könnten Ihre Forschungsfragen neu gestalten.

Das Ziel ist nicht nur zu fassen, sondern zu interpretieren. Ihre Analyse sollte die Frage "Und was nun?" beantworten und erklären, warum Ihre Ergebnisse wichtig sind und was sie in einem breiteren Kontext bedeuten.

Letztendlich hilft Ihnen die Wahl des richtigen Weges von Anfang an, einen komplexen Textberg in eine klare, fokussierte und aufschlussreiche Geschichte zu verwandeln.

Daten für die Analyse vorbereiten

Fantastische Analysen entstehen nicht einfach so. Sie beginnen lange bevor Sie überhaupt daran denken, Ihren ersten Code anzuwenden. Die eigentliche Arbeit beginnt mit der sorgfältigen Vorbereitung Ihrer Rohmaterialien – Ihrer Interviewtranskripte, Feldforschungsnotizen und Antworten auf offene Umfragen.

Stellen Sie es sich wie die Mise en place eines Kochs vor. Alles muss vorbereitet und perfekt organisiert sein, bevor das eigentliche Kochen beginnt. Wenn Sie Einblicke gewinnen wollen, denen Sie wirklich vertrauen können, ist die richtige Durchführung dieser Phase nicht verhandelbar.

Das Herzstück dieses Prozesses ist die genaue Transkription. Es mag wie eine Verwaltungsaufgabe erscheinen, aber Ihr Transkript ist Ihr primärer Datensatz. Ein einziges falsch gehörtes Wort oder eine fehlende Phrase kann die Geschichte eines Teilnehmers völlig verzerren und Ihre gesamte Analyse in die falsche Richtung lenken.

Das manuelle Transkribieren von Audio ist eine langsame, schmerzhafte Plackerei – jeder, der es getan hat, weiß das. Wenn Sie stundenlange Interviews vor sich haben, tun Sie sich selbst einen Gefallen und finden Sie ein zuverlässiges Werkzeug, um Ihr Audio kostenlos in Text zu transkribieren. Es kann Ihnen Dutzende von Stunden ersparen und Ihnen einen viel genaueren Ausgangspunkt geben. Aber denken Sie daran, ein gutes Transkript ist mehr als nur die Worte.

Mehr als nur Worte auf einer Seite

Ein einfaches Transkript gibt Ihnen das "Was", aber ein wirklich reichhaltiges erfasst das "Wie". Ein großer Teil der menschlichen Kommunikation findet in den stillen Räumen zwischen den Worten statt. Um wirklich das vollständige Bild zu erhalten, müssen Ihre Transkripte mehr als nur den Dialog enthalten.

Ich füge immer Anmerkungen für Dinge hinzu wie:

- Signifikante Pausen: Eine lange Stille kann alles bedeuten, von tiefer Reflexion bis hin zu ernsthaftem Unbehagen. Es ist ein Hinweis.

- Emotionaler Ton: Notieren Sie das Lachen, die Seufzer oder jegliche Veränderungen in der Stimmenergie. Ich verwende oft einfache Tags wie [Stimme bricht] oder [spricht schneller].

- Nonverbale Hinweise: Wenn Sie Video haben oder im Raum waren, notieren Sie wichtige Körpersprache. Ein Schulterzucken, ein Nicken, sich zurücklehnen – all das ist Teil der Daten.

Diese kleinen Details fügen entscheidende Bedeutungsebenen hinzu, die eine einfache Textdatei völlig vermisst. Wenn ein Teilnehmer sagt: "Mir geht es gut", bedeutet das zwei völlig unterschiedliche Dinge, je nachdem, ob es von einem Lachen oder einem schweren Seufzer gefolgt wird.

Meine persönliche Regel lautet: Wenn es sich im Moment wichtig anfühlte, gehört es ins Transkript. Zweifeln Sie Ihre Intuition während des Interviews nicht an; dieses Bauchgefühl ist oft Ihr erster analytischer Funke.

Vom Chaos zur Klarheit

Sobald Ihre Transkripte reichhaltig und bereit sind, ist die nächste Herausforderung die Organisation. Es ist leicht, sich begraben zu fühlen, wenn man potenziell Hunderte von Seiten Text vor sich hat. Das Ziel hier ist es, ein System aufzubauen, das Ihre Daten zugänglich und nicht überwältigend erscheinen lässt.

Eine einfache, aber unglaublich effektive Strategie ist die Erstellung eines Master-Dokuments oder einer Tabellenkalkulation. Betrachten Sie es als ein Inventar all Ihrer Datenquellen. Ich füge Spalten für eine Teilnehmer-ID, das Datum, den Datentyp (Interview, Feldforschungsnotiz usw.) und eine kurze Zusammenfassung hinzu. Allein das wird Sie davor bewahren, eine wichtige Datei zu verlieren.

Der letzte und vielleicht wichtigste Vorbereitungsschritt ist das, was ich Datenimmersion nenne. Das bedeutet Lesen. Und dann nochmal lesen. Lesen Sie alles, ohne den Druck, mit der Analyse zu beginnen. Lassen Sie einfach die Geschichten, die Phrasen und die wiederkehrenden Ideen auf sich wirken. Es ist diese tiefe Vertrautheit, die es Mustern ermöglicht, Ihnen aufzufallen, wenn Sie endlich mit dem Kodieren beginnen.

Vom Rohtext zu umsetzbaren Codes

Sobald Sie Zeit mit der Immersion in die Daten verbracht haben, ist es an der Zeit, mit dem Sinnstiften des Chaos zu beginnen. Hier kommt das Kodieren ins Spiel – der Prozess, all diesen Rohtext in kleine, beschriftete Sinnabschnitte zu zerlegen. Stellen Sie es sich wie die Erstellung eines detaillierten Index für Ihre Daten vor; jeder Code ist ein Tag, der eine einzelne Idee, ein Konzept oder eine Emotion erfasst.

Das Kodieren ist wirklich dort, wo die Analyse beginnt. Es ist der grundlegende Schritt, der Sie von einem dichten, einschüchternden Transkript zu einer strukturierten Sammlung erster Ideen führt. Es geht nicht nur ums Zusammenfassen; es geht darum, den Text systematisch zu dekonstruieren, um seine Bausteine zu sehen.

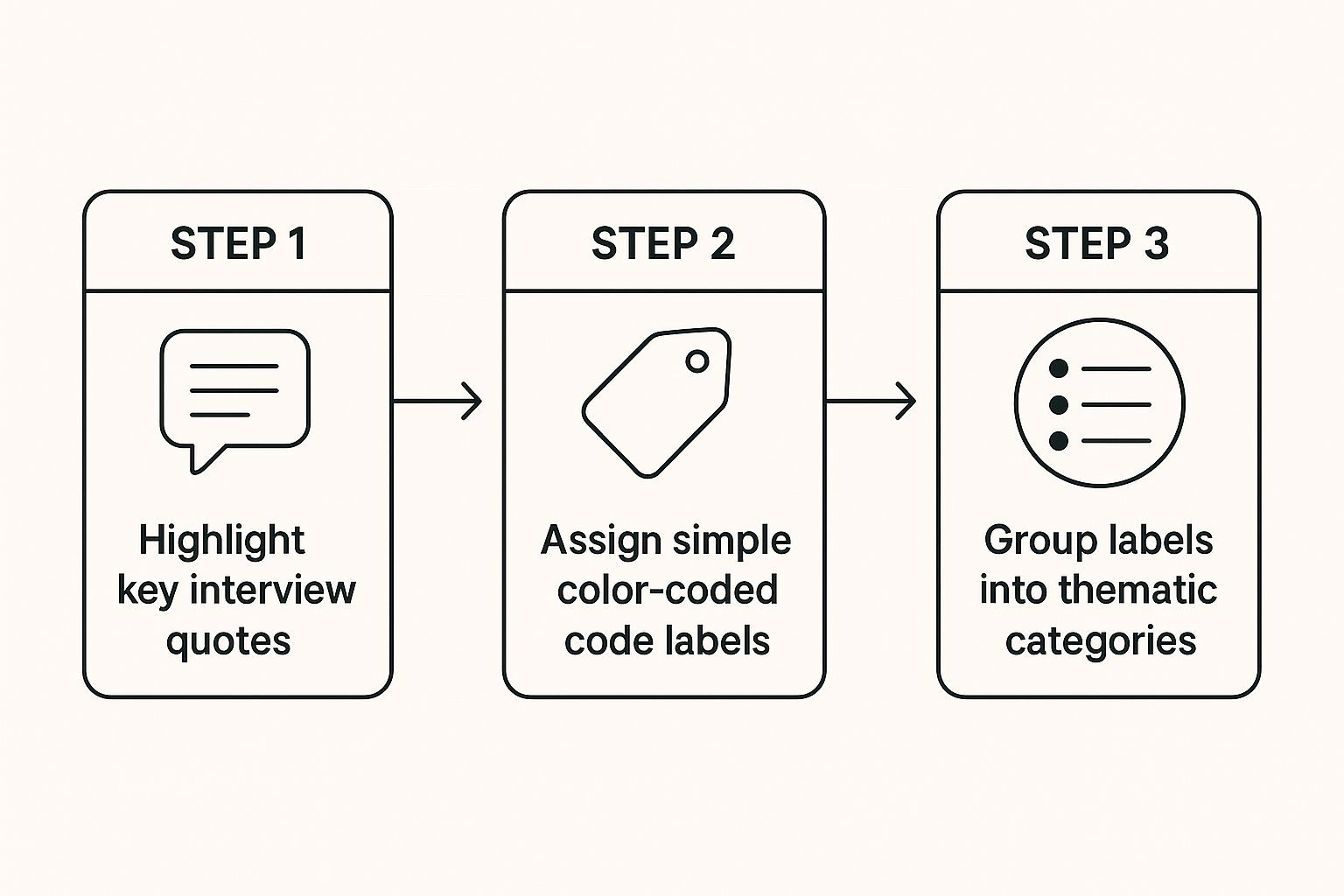

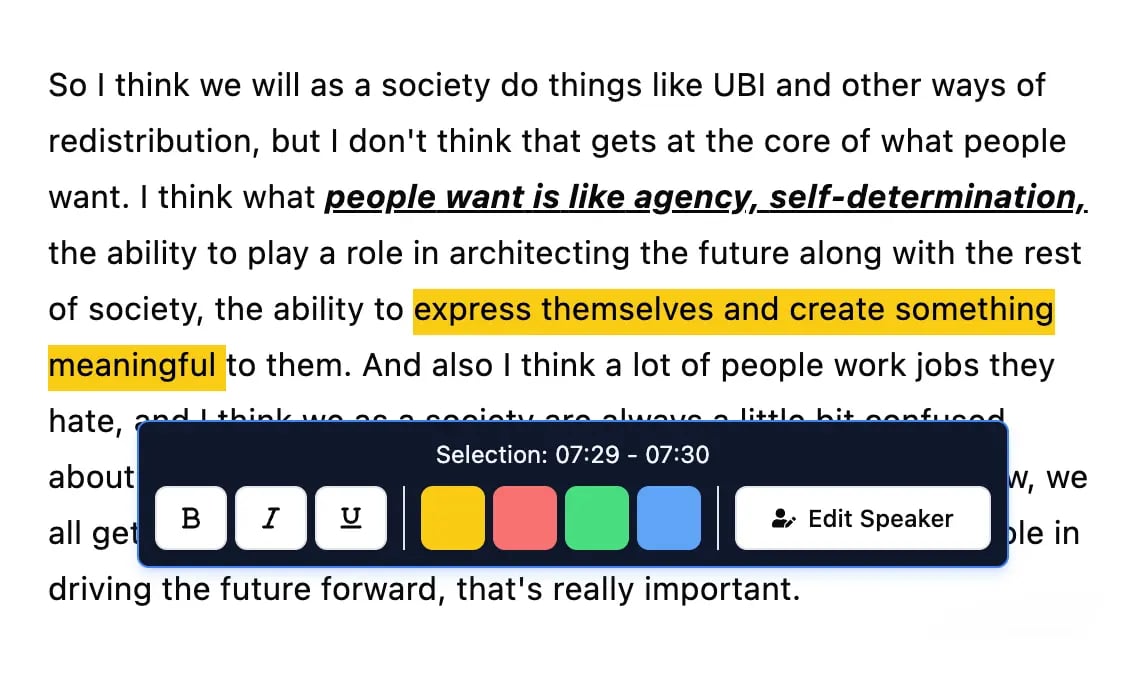

Dieser visuelle Fluss zeigt, wie Sie von hervorgehobenem Text zu anfänglichen Codes und dann zur Gruppierung dieser Codes in breitere Kategorien gelangen können.

Die Infografik bringt den Kern des Kodierens auf den Punkt: das Erkennen wichtiger Aussagen und das Zuweisen von Labels, die sie für die thematische Gruppierung vorbereiten.

Mit einem sauberen Blatt beginnen

Eine der häufigsten Methoden, um zu beginnen, ist das offene Kodieren, bei dem Sie ohne vorgefasste Meinungen beginnen. Sie lesen die Daten Zeile für Zeile und erstellen Codes basierend auf dem, was direkt aus dem Text hervorsticht. Es ist ein induktiver, von unten nach oben gerichteter Prozess, der sich perfekt für explorative Forschung eignet, wenn Sie noch nicht wissen, welche Muster Sie finden werden.

Wenn Sie beispielsweise Interviewtranskripte zur Arbeitsplatzzufriedenheit analysieren, könnten Sie Codes wie diese entwickeln:

- "Wertschätzung durch das Management"

- "Frustration über veraltete Werkzeuge"

- "Positive Teamzusammenarbeit"

Der Trick besteht darin, nah an den Daten zu bleiben und die eigenen Worte der Teilnehmer oder einfache beschreibende Phrasen zu verwenden.

Ein vorgefertigtes Framework verwenden

Andererseits könnten Sie deduktives Kodieren verwenden. Dieser Ansatz ist sehr nützlich, wenn Sie bereits eine Theorie oder ein Framework haben, das Sie testen möchten. Sie beginnen mit einer Liste vordefinierter Codes und suchen dann nach Beweisen dafür in Ihren Daten.

Stellen Sie sich vor, Sie analysieren Kundenfeedback anhand eines bekannten Kundendienstmodells. Ihre anfänglichen Codes könnten "Reaktionsfähigkeit", "Zuverlässigkeit" und "Empathie" umfassen. Diese Methode ist viel strukturierter und effizienter, um Ideen zu bestätigen oder herauszufordern, die Sie bereits haben. Für eine tiefere Auseinandersetzung mit der Anwendung dieser Techniken bietet unser Leitfaden zur Analyse von Interviewdaten spezifischere Beispiele.

Unabhängig davon, welchen Ansatz Sie wählen, ist das Ziel dasselbe: die Erstellung einer Reihe konsistenter, aussagekräftiger Labels, die Sie auf Ihren gesamten Datensatz anwenden können. Dieser Prozess ist selten linear; Sie werden Codes wahrscheinlich überarbeiten, zusammenführen und aufteilen, wenn Ihr Verständnis tiefer wird.

Analyse konsistent halten

Wenn Sie mit der Entwicklung Ihrer Codes beginnen, ist die Erstellung eines Codebuchs absolut unerlässlich. Dies ist ein zentrales Dokument, das jeden Code definiert und klare Regeln für seine Anwendung bereitstellt. Ein solides Codebuch enthält:

- Codename: Ein kurzes, beschreibendes Label (z. B. "Ressourcenbeschränkungen").

- Vollständige Definition: Eine detaillierte Erklärung, was der Code im Kontext Ihrer Studie bedeutet.

- Ein- und Ausschlusskriterien: Spezifische Regeln, was diesem Code zugewiesen werden sollte und was nicht.

- Beispielzitat: Ein klares Beispiel aus Ihren Daten, das den Code in Aktion veranschaulicht.

Dieses Dokument wird zu Ihrem analytischen Nordstern. Es stellt sicher, dass Sie (und jeder andere in Ihrem Team) Codes konsistent anwenden, was Ihre Ergebnisse viel zuverlässiger und verteidigungsfähiger macht. Es zwingt Sie auch, kritisch über Ihre Labels nachzudenken und verhindert "Coder-Drift", bei dem sich die Bedeutung eines Codes im Laufe der Zeit langsam ändert.

Fortgeschrittene Werkzeuge für tiefere Einblicke

Sprechererkennung

Identifiziere automatisch verschiedene Sprecher in deinen Aufnahmen und beschrifte sie mit ihren Namen.

Bearbeitungswerkzeuge

Bearbeite Transkripte mit leistungsstarken Werkzeugen wie Suchen und Ersetzen, Sprecherzuordnung, Rich-Text-Formate und Hervorhebungen.

Zusammenfassungen und Chatbot

Erstelle Zusammenfassungen und andere Erkenntnisse aus deinem Transkript, wiederverwendbare benutzerdefinierte Prompts und Chatbot für deine Inhalte.

Entdecken Sie die Kernthemen in Ihren Daten

Sie haben die harte Arbeit des Kodierens Ihrer Daten geleistet und im Wesentlichen einen detaillierten Index jeder Idee in Ihren Transkripten erstellt. Jetzt ist es an der Zeit, herauszuzoomen. Dies ist der Teil, in dem Sie von der reinen Kennzeichnung zur wirklichen Interpretation übergehen und die Verbindungen zwischen Ihren Codes herstellen, um die großen, übergreifenden Themen zu finden.

Hierbei geht es nicht darum, Ihre Codes ordentlich in Stapel zu sortieren. Echte thematische Analyse ist dort, wo Sie die Beziehungen und Muster aufdecken, die eine überzeugende Geschichte erzählen. Es ist der Moment, in dem Ihre Rohdaten beginnen, aussagekräftige, strategische Einblicke zu offenbaren.

Von Codes zu Konzepten

Der erste wirkliche Schritt beim Finden von Themen ist das Gruppieren Ihrer zusammengehörigen Codes. Legen Sie sie alle dort aus, wo Sie sie sehen können – ich bin ein Fan von Haftnotizen an einer Wand, aber ein digitales Whiteboard oder eine Mindmap funktioniert genauso gut. Bringen Sie sie einfach heraus und suchen Sie nach Codes, die sich verbunden anfühlen oder auf dieselbe zugrunde liegende Idee hinzuweisen scheinen.

Stellen Sie sich zum Beispiel vor, Sie analysieren Interviews über Fernarbeit. Sie haben möglicherweise Codes wie „Zoom-Müdigkeit“, „informelle Chats vermissen“ und „Schwierigkeiten bei der Zusammenarbeit an komplexen Aufgaben“.

Jeder einzelne ist eine spezifische Beobachtung. Aber wenn Sie sie zusammen betrachten, beginnen sie, einen größeren konzeptionellen Eimer zu bilden. Sie könnten diese Gruppe zunächst etwas wie „Herausforderungen der virtuellen Zusammenarbeit“ nennen.

Ehrlich gesagt, dieser Prozess ist immer etwas chaotisch und Sie werden ihn ein paar Mal wiederholen. Sie werden Codes verschieben, neue Cluster erstellen und Ihre Gruppen umbenennen, wenn Sie ein besseres Gefühl für die Daten bekommen. Das Ziel ist nicht, es beim ersten Versuch perfekt zu machen, sondern zu beginnen zu sehen, wie all diese einzelnen Datenpunkte mit größeren Ideen verknüpft sind.

Visualisieren Sie die Verbindungen

Manchmal kann das bloße Anstarren einer Liste von Codes ziemlich uninspiriert wirken. Hier können visuelle Techniken ein absoluter Wendepunkt sein, besonders wenn Sie versuchen herauszufinden, wie man qualitative Forschungsdaten analysiert intuitiver.

Zwei meiner Lieblingsmethoden sind Affinity Diagramming und Mind Mapping.

- Affinity Diagramming: Dies ist die klassische Haftnotiz-Methode. Schreiben Sie jeden Code auf eine separate Notiz und verschieben Sie sie physisch auf einer Wand oder einem Whiteboard. Beginnen Sie, sie basierend auf Ihrem Bauchgefühl zu gruppieren, ohne zu viel darüber nachzudenken. Dieser praktische Ansatz deckt oft Verbindungen auf, die Sie in einer Tabelle völlig übersehen würden.

- Mind Mapping: Beginnen Sie mit einer zentralen Forschungsfrage oder einem Hauptcode in der Mitte einer Seite und verzweigen Sie sich dann mit verwandten Codes und Ideen. Dies ist großartig für die Visualisierung hierarchischer Beziehungen – es hilft Ihnen zu sehen, welche Ideen zentral sind und welche nur unterstützende Details sind.

Diese visuellen Methoden helfen Ihnen, aus der linearen, textbasierten Denkweise auszubrechen und räumlicher und kreativer zu denken.

Ihre Themen müssen mehr tun, als nur die Daten zusammenzufassen; sie müssen sie interpretieren. Ein solides Thema hat eine Erzählung. Es macht ein Argument oder bietet einen Standpunkt zu Ihren Daten und beantwortet die allwichtige „Was nun?“-Frage.

Testen Sie Ihre Themen auf Herz und Nieren

Sobald Sie eine Reihe potenzieller Themen haben, müssen Sie hart zu ihnen sein. Ein Thema ist nur so stark wie die Beweise, die es untermauern. Stellen Sie sich für jedes einzelne ein paar kritische Fragen:

- Ist es eindeutig? Erfasst dieses Thema eine einzigartige Idee oder überschneidet es sich zu sehr mit einem anderen? Wenn sie zu nah beieinander liegen, müssen Sie sie möglicherweise zusammenführen oder Ihre Definitionen verfeinern.

- Ist es gut unterstützt? Können Sie mehrere überzeugende Zitate oder Datenauszüge anführen, die dieses Thema klar zum Leben erwecken? Wenn Sie Schwierigkeiten haben, gute Beweise zu finden, ist es wahrscheinlich kein echtes Thema.

- Beantwortet es die Forschungsfrage? Jedes einzelne Thema sollte Ihnen direkt helfen, Ihre Kernforschungsziele zu beantworten. Wenn nicht, ist es vielleicht eine interessante Randnotiz, aber keine zentrale Erkenntnis.

Indem Sie Ihre aufkommenden Themen systematisch hinterfragen, stellen Sie sicher, dass Ihre endgültige Analyse nicht nur eine Sammlung zufälliger Ideen ist, sondern eine kohärente und verteidigungsfähige Geschichte, die fest in Ihren Daten verankert ist. Das ist es, worum es bei robuster qualitativer Analyse geht.

Nutzen Sie moderne Werkzeuge, um Ihre Analyse zu optimieren

Das klassische Bild eines qualitativen Forschers ist jemand, der von Textmarkern umgeben ist und eine Wand voller Haftnotizen hat. Während diese Methode immer noch ihren Platz hat, kann die richtige Software einen vollständigen Wendepunkt darstellen.

Der Übergang von der manuellen Analyse zu modernen Werkzeugen spart nicht nur Zeit. Er eröffnet völlig neue Wege, Ihre Daten zu sehen, insbesondere wenn Sie mit einem großen oder besonders komplexen Datensatz arbeiten.

Spezialisierte Software für die qualitative Datenanalyse (oder QDAS) fungiert im Wesentlichen als Kommandozentrale für Ihre Forschung. Denken Sie an Plattformen wie NVivo oder MAXQDA als digitale Werkbänke. Sie sind darauf ausgelegt, Ihnen bei der Verwaltung von Hunderten von Seiten Transkripten, der Organisation Tausender einzelner Codes und der Visualisierung der komplexen Beziehungen zwischen ihnen zu helfen. Hier steigen Sie von der einfachen Sortierung zur echten, komplexen Mustererkennung auf.

Wählen Sie Ihr Toolkit

Sie müssen nicht immer die schwere Maschinerie auffahren. Für kleinere Projekte – sagen wir, etwa ein Dutzend Interviews – kann eine gut organisierte Tabelle in Google Sheets oder Excel überraschend effektiv sein. Sie können einfach Spalten für Zitate, Codes und Notizen einrichten, um Ihre anfängliche Analyse sauber und unkompliziert zu halten.

Aber wenn Ihr Datensatz wächst, wird der Wert dedizierter Software unmöglich zu ignorieren sein.

- QDAS (NVivo, MAXQDA): Diese Werkzeuge sind darauf ausgelegt, riesige Mengen an Text-, Audio- und sogar Videodaten zu verarbeiten. Ihre wahre Stärke liegt in der Verknüpfung von Codes mit Themen und dann der Verbindung dieser Themen mit Teilnehmerdemografien. Dies ermöglicht es Ihnen, komplexe Fragen zu stellen wie: „Wie sprachen Manager im Vergleich zu Junior-Mitarbeitern über die Work-Life-Balance?“

- KI-gestützte Plattformen: Eine neue Welle von Tools integriert jetzt KI, um bei Aufgaben wie automatischer Transkription zu helfen und sogar erste Codes vorzuschlagen. Sie können oft Muster auf hoher Ebene oder Stimmungstrends erkennen, die Sie während eines manuellen ersten Durchgangs übersehen könnten.

Diese Bildschirmaufnahme der MAXQDA-Oberfläche zeigt, wie ein Forscher ein Transkript sehen, farbcodierte Tags anwenden und sein gesamtes Codesystem in einem Fenster anzeigen kann.

Die wahre Magie liegt in der Integration. Ihre Daten, Ihre Codes und Ihre analytischen Notizen leben alle am selben Ort. Dies schafft eine klare und verteidigungsfähige Audit-Spur, die genau zeigt, wie Sie von Rohdaten zu Ihrer endgültigen Interpretation gelangt sind.

Das beste Werkzeug ersetzt nicht Ihr kritisches Denken – es unterstützt es. Software hilft, Komplexität zu bewältigen, damit Sie sich auf die einzigartig menschliche Aufgabe der Interpretation und Sinngebung konzentrieren können.

Integration von KI und quantitativen Elementen

Die Rolle der Technologie in der qualitativen Analyse entwickelt sich ständig weiter, und wir sehen, wie mehr Forscher Ansätze kombinieren, die früher völlig getrennt waren.

Eine der interessantesten Entwicklungen ist die Verwendung statistischer Werkzeuge zur Verwaltung und Interpretation von Ergebnissen. Obwohl die Forschung im Kern nicht-numerisch ist, kann die Einbeziehung von Methoden wie deskriptiver Statistik Ihnen helfen, Muster in qualitativen Daten zu erkennen, die quantitative Elemente aufweisen. Zum Beispiel könnten Sie die Häufigkeit bestimmter Codes in verschiedenen Teilnehmergruppen zählen.

Und obwohl unser Fokus hier auf qualitativen Methoden liegt, kann ein Blick auf angrenzende Bereiche wie Datenanalytik im Hochschulwesen neue Ideen liefern, wie große Datensätze mit modernen Werkzeugen verarbeitet werden können.

Letztendlich, ob Sie eine einfache Tabelle oder eine fortschrittliche KI-Software verwenden, alles beginnt mit einem genauen Transkript. Das ist die Grundlage. Um das richtig zu machen, lesen Sie unsere Bewertung der besten Meeting-Transkriptionssoftware, um ein Tool zu finden, das zu Ihrem Workflow passt.

👥 Wer profitiert am meisten von modernen Transkriptionswerkzeugen?

📚 Forscher

Organisieren Sie schnell große Interviewmengen in aussagekräftige Erkenntnisse.

📰 Journalisten

Extrahieren Sie Zitate und überprüfen Sie Fakten in Minuten statt Stunden.

🏢 Teams & Unternehmen

Teilen Sie Transkripte abteilungsübergreifend für eine bessere Zusammenarbeit.

🎙️ Kreative

Verwandeln Sie Interviews in Podcasts, Blogs oder Social-Media-Inhalte.

Häufig gestellte Fragen zur qualitativen Analyse

Die qualitative Analyse wirft immer wieder ein paar knifflige Fragen auf, selbst für diejenigen unter uns, die das schon seit Jahren machen. Es ist völlig normal, sich mit Themen wie Bias, Stichprobengröße und der Frage, welche Methode wirklich die richtige ist, auseinanderzusetzen. Gehen wir einige der häufigsten Fragen direkt an.

Eine der größten Hürden ist unsere eigene Subjektivität. Als Forscher sind Sie das analytische Werkzeug, was bedeutet, dass Ihre eigene Perspektive unweigerlich beeinflusst, wie Sie die Daten sehen. Der Versuch, ein völlig neutraler Beobachter zu sein, ist ein aussichtsloser Kampf. Das eigentliche Ziel ist nicht eine falsche Objektivität, sondern Transparenz.

Ich mache es mir zur Gewohnheit, für jedes einzelne Projekt ein "Forscher-Tagebuch" zu führen. Darin notiere ich meine anfänglichen Annahmen, bevor ich überhaupt beginne, meine Bauchgefühle während eines Interviews oder Ideen, die mir unterwegs einfallen. Diese einfache Praxis hilft mir, meine eigenen Vorurteile zu erkennen, damit ich sie bewusst beiseitelegen und mich darauf konzentrieren kann, was die Daten tatsächlich aussagen. Es geht um Selbstwahrnehmung.

Bestimmung der richtigen Stichprobengröße

Eine weitere Frage, die ich ständig höre, ist: "Wie viele Interviews brauche ich eigentlich?" Im Gegensatz zur quantitativen Forschung gibt es hier keine magische Zahl. Die Antwort ist ein Konzept namens Sättigung.

Sie haben Sättigung erreicht, wenn Sie weiterhin Daten sammeln, aber nichts Neues mehr hören. Die Geschichten beginnen sich vertraut anzuhören, die gleichen Themen tauchen immer wieder auf, und Sie haben das Gefühl, dass Ihre analytischen Kategorien solide sind. Für eine eng gefasste Studie kann dies bereits nach 12-15 Interviews der Fall sein. Für ein umfangreicheres, komplexeres Thema benötigen Sie möglicherweise mehr.

Machen Sie sich vor Beginn keine Gedanken über eine Zielzahl. Es geht um den Reichtum der Daten. Ein wirklich aufschlussreiches, tiefgehendes Interview kann mehr wert sein als drei oberflächliche. Die Qualität Ihrer Teilnehmer und Ihre Fähigkeiten als Interviewer sind weitaus wichtiger als die endgültige Anzahl.

Kombination verschiedener Analysemethoden

Schließlich fragen sich die Leute oft, ob es in Ordnung ist, Analysemethoden zu mischen und anzupassen. Die Antwort ist ein klares Ja, solange Sie einen guten Grund dafür haben. Dieser Ansatz, bekannt als methodische Triangulation, kann Ihre Ergebnisse erheblich stärken.

Sie könnten zum Beispiel eine thematische Analyse verwenden, um einen Überblick über die Muster in all Ihren Interviews zu erhalten, und dann mit einer narrativen Analyse einige spezifische Transkripte genauer untersuchen, um einzelne Geschichten wirklich zu vertiefen.

So könnten Sie vorgehen:

- Breit beginnen: Beginnen Sie mit einer Methode wie der thematischen Analyse, um die allgemeine Landschaft Ihres gesamten Datensatzes zu kartieren.

- In die Tiefe gehen: Wählen Sie anschließend einige der überzeugendsten Interviews aus und wenden Sie eine fokussiertere Methode wie die Diskursanalyse an, um die subtilen Details der Sprache zu untersuchen.

- Ergebnisse integrieren: Der letzte Schritt besteht darin, zu erklären, wie die Erkenntnisse aus jeder Methode sich gegenseitig unterstützen oder sogar herausfordern, was Ihnen eine wesentlich robustere und vielschichtigere Interpretation liefert.

Beim Kombinieren von Methoden geht es nicht darum, einfach alles auszuprobieren, um zu sehen, was funktioniert. Es ist ein strategischer Schritt, der es Ihnen ermöglicht, Ihre Daten aus mehreren Blickwinkeln zu betrachten, was zu weitaus glaubwürdigeren und aufschlussreicheren Schlussfolgerungen führt.

⚠️ Riskieren Sie nicht, wichtige Erkenntnisse zu verlieren

Manuelle Transkription verschwendet Stunden und birgt Fehler, die Ihre Forschung schwächen. Sichere, KI-gestützte Transkripte geben Ihnen eine solide Grundlage. 👉 Probieren Sie es jetzt auf Transcript.LOL aus

Sind Sie bereit, Ihre Interviews und Fokusgruppen in klare, umsetzbare Texte umzuwandeln? Transcript.LOL bietet blitzschnelle, hochpräzise Transkriptionen, damit Sie sich auf die Analyse und nicht auf die Administration konzentrieren können. Beginnen Sie jetzt kostenlos mit der Transkription und optimieren Sie Ihren Forschungs-Workflow.